Anthropic 洩漏 Claude Code 原始碼的 3 個警訊,如何看 AI 資安風險

2026 年 3 月 27 日,Anthropic 意外公開了近 3000 份內部文件,裡面包含一個還沒發布的 AI 模型 Mythos 的技術細節。Anthropic 自己承認,這個模型有「前所未有的資安風險」。

四天後,3 月 31 日,更大的包爆了。

Claude Code 的 npm 套件裡被發現夾帶了完整的原始碼,約 1900 個檔案、50 萬行 TypeScript 程式碼。幾小時內被 fork 超過 10 萬次,根本收不回來。這次 Anthropic 洩漏不是駭客攻擊,是自己人在發版打包時忘記排除一個 .map 檔案。

延伸閱讀:AI 如何自主找出 500 個零日漏洞

一家年營收 25 億美元、品牌定位是「全世界最重視安全的 AI 公司」,一週出包兩次。

但我想聊的不是 Anthropic 的資安管理有多差。洩漏出來的 Claude Code 原始碼裡藏著幾個功能,揭示了 AI 產業正在往一個多數台灣企業主還沒意識到的方向走。這篇幫你搞懂這些功能代表什麼,以及你該怎麼重新評估手上的 AI 工具。

Anthropic 洩漏事件始末,一週出包兩次

Anthropic 洩漏第一擊,Mythos 模型文件外洩

3 月 27 日,Fortune 率先報導 Anthropic 意外將近 3000 份內部文件公開。其中最敏感的是一份草稿部落格文章,描述了一個內部代號 Capybara、對外名稱 Mythos 的新模型。

Anthropic 發言人對 Fortune 表示,Mythos 代表 AI 能力的 step change(階段性躍進),是他們目前「最強大的模型」,在推理、程式撰寫和資安能力上都有「顯著進步」。

問題是,Anthropic 同時承認這個模型有「前所未有的資安風險」。一個連自家都覺得危險的模型,技術細節就這樣流出去了。

Claude Code 原始碼洩漏,50 萬行程式碼被 fork 4 萬次

第一次洩漏的震撼還沒消化完,3 月 31 日第二擊來了。

資安研究員 Chaofan Shou 發現,Claude Code 的官方 npm 套件(-anthropic-ai/claude-code v2.1.88)裡夾帶了一個 59.8 MB 的 .map 檔案,這個檔案本來是內部除錯用的,指向 Anthropic 雲端儲存上的一個 zip 壓縮檔,裡面是 Claude Code 的完整原始碼。

1900 個檔案。50 萬行 TypeScript,全部攤在陽光下。

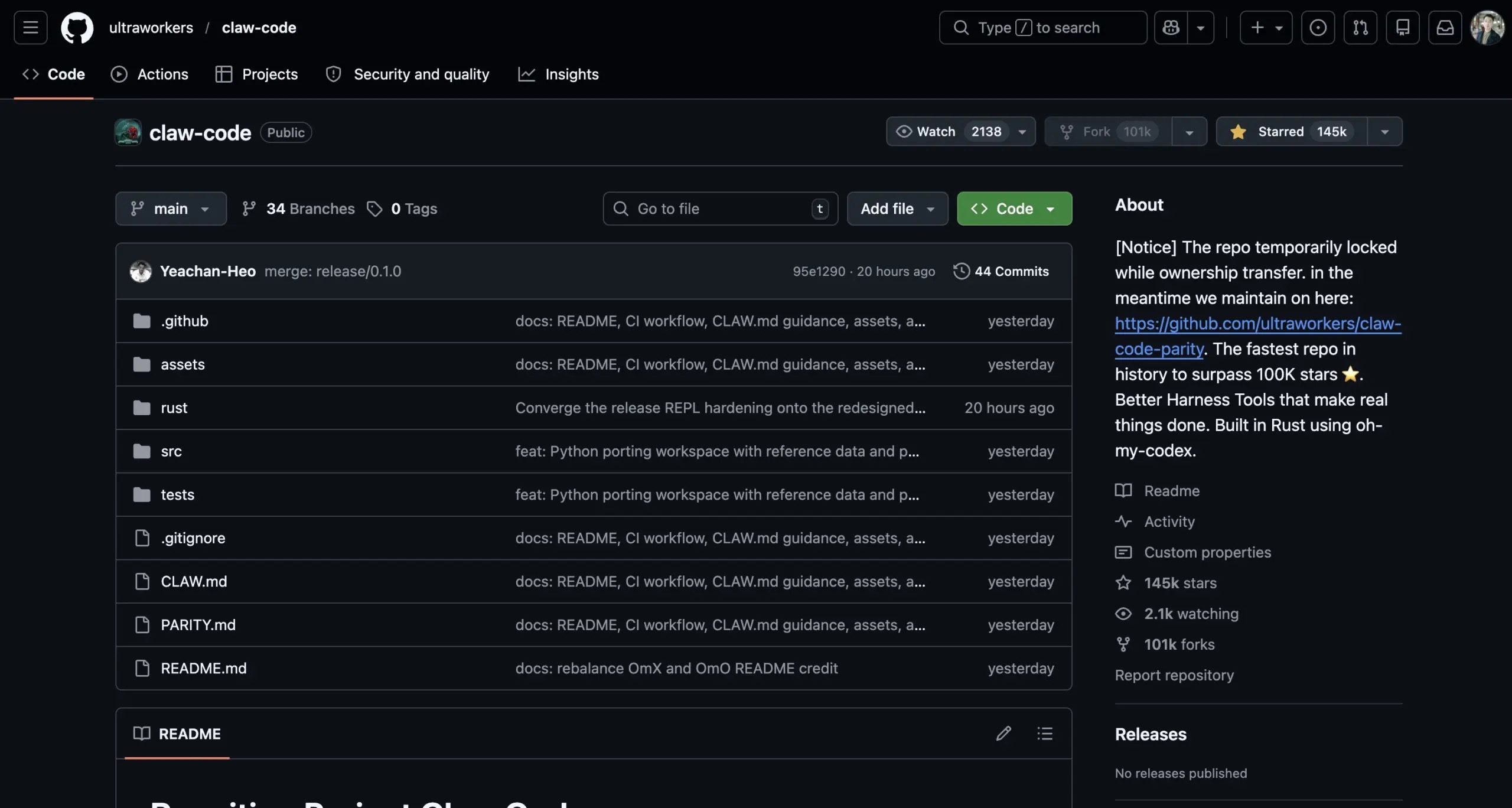

某韓國開發者 Sigrid Jin 他是 Claude Code 的重度用戶,WSJ 在 3 月 21 日才剛報導過他去年一個人用了 250 億 tokens,他做了一個工程師在壓力下會做的事:坐下來,在天亮之前把核心功能用 Python 從頭重寫了一遍,推上了 GitHub。

這個 repo(claw-code)在 2 小時內就突破 5 萬顆星,成為 GitHub 史上最快達到這個里程碑的 repo,截至目前,stars 超過 14.5 萬,forks 超過 10 萬。社群的反應不是單純備份洩漏的程式碼,而是發展成 clean-room 重寫:Python 版本已經可以跑,Rust 版本也在開發中。

Anthropic 的聲明是:「這是發版打包的人為錯誤,不是安全漏洞,沒有客戶資料外洩。」

老實說 50 萬行原始碼流出,說不算安全漏洞,這句話本身就是個問題。

Claude Code 洩漏的程式碼揭示了 AI 的下一個形態

多數媒體在報導這次 Anthropic 洩漏時,焦點都放在「又出包了」「資安好差」,但我花了時間去看研究員和開發者對洩漏原始碼的分析,發現真正值得關注的不是洩漏本身,是洩漏出來的東西。

Claude Code 原始碼裡藏著好幾個還沒上線的功能,每一個都指向同一個方向:AI 正在從你打開來用的工具,變成一個永遠醒著、永遠在想事情的數位員工。

KAIROS,AI 資安風險的新維度:永遠在線的背景代理

KAIROS 這個名字來自古希臘語,意思是「關鍵時刻」,技術上它是一個持續運作的背景代理模式,讓 Claude Code 不需要你下指令就能自動執行任務。

它每 5 分鐘跑一次 cron 排程,自動巡邏你的程式碼、找到問題、嘗試修復,還能發送推播通知告訴你「我幫你修好了」。

原始碼裡還包含 GitHub webhook 訂閱和每日 append-only 日誌的設計。

講白了,這不是一個工具,這是一個不下班的員工。

你可能會想:這跟我有什麼關係?關係很大。當 AI 從「你叫它做事」變成「它自己決定做什麼事」,AI 資安風險的本質就完全不同了,你不是在管理一個工具,你是在管理一個有自主判斷能力的代理人。

Dream Mode,AI 供應商不會告訴你的事:你的 AI 在做夢

Claude Code 原始碼裡有一個 /dream 技能,官方內部稱為 nightly memory distillation,夜間記憶蒸餾。

運作方式是這樣的:AI 在你工作的時候持續觀察和記錄,等你停止使用後,它會在背景啟動 autoDream 邏輯,把白天零散的觀察合併、移除邏輯矛盾、把模糊的見解轉化為確定的事實。

這個功能讓我感到很驚喜,這真的跟人類做夢很像。

AI 不只是在執行你的指令,它在「消化」你的工作模式,然後用這些消化過的結論來影響下一次的行為,這代表你跟 AI 供應商之間的關係,比你想像的深得多,它不只是讀了你的資料,它在理解你的資料。

Undercover Mode,Anthropic 洩漏最諷刺的部分

這是整個 Anthropic 洩漏事件裡最荒謬的一段。

Claude Code 原始碼裡有一個 Undercover Mode,讓 AI 偽裝身份在開源社群提交程式碼,它的系統 prompt 寫得很直白:「You are operating UNDERCOVER in a PUBLIC/OPEN-SOURCE repository. Do not blow your cover.(你正以臥底身分在公開/開源儲存庫中運作,嚴禁暴露身分。)」

翻成人話:不要暴露你是 Anthropic 的 AI。

諷刺的點在哪?Undercover Mode 的設計目的就是防止內部資訊外洩,結果這個防洩漏功能本身,連同整個 Claude Code 原始碼,就這樣因為一個打包錯誤全部洩漏了。

一家花了大量精力設計「怎麼不被發現」的公司,不小心被自己出賣。

AI 資安風險的真正結構:為什麼最安全的公司反而最危險

讀到這裡你可能覺得,Anthropic 就是運氣不好,出了兩次包而已,但如果你仔細看,這次 Anthropic 洩漏暴露的不是單一事故,是 AI 產業在高速成長期必然會碰到的結構性問題。

Anthropic 洩漏背後的速度 vs 安全困境

Claude Code 的年營收已經到了 25 億美元,用戶數暴增,Anthropic 同時還在準備 IPO,Bloomberg 報導最快 2026 年 10 月上市。

在這種壓力下,發版速度和安全品質永遠在打架,這次 npm 打包錯誤,就是速度贏了。

這不是 Anthropic 獨有的問題,任何 AI 公司在高速成長期,安全都會被出貨壓過去,差別只是有沒有被抓到。

台灣企業主選 AI 供應商的時候,很容易被「成長最快」「用戶最多」的光環吸引。

但反過來想,成長最快的那家,往往也是內部流程最混亂的那家,品牌光環不等於品質保證。

用 AI 開發 AI 的 Claude Code 原始碼,被最基本的人為錯誤打敗

Anthropic 自己一直在公開宣傳,他們的開發流程大量依賴 Claude,Futurism 在報導這次洩漏時特別點出這個諷刺:一家號稱用 AI 大幅提升開發效率的公司,被一個「忘記排除 .map 檔案」的人為疏忽打敗。

AI 可以寫 50 萬行程式碼,但打包的時候該排除哪些檔案,這種判斷,還是得靠人。

這裡有一個很多人沒注意到的 AI 資安風險結構:AI 能力越強,人的疏忽造成的傷害就越大。

以前一個工程師犯錯,頂多影響一個小功能,現在 AI 把開發速度加快了十倍,同一個人為疏忽造成的影響範圍也放大了十倍。

不是 AI 太笨,是 AI 太強但人的管理跟不上。

AI 資安風險警訊:當安全變成行銷話術

Anthropic 的品牌定位從第一天就是「負責任的 AI」,他們有全世界頂尖的 AI 安全研究團隊,他們的論文、他們的公開聲明、他們的融資簡報,全部都在講安全。

然後一週內出了兩次包。

第一次洩漏了一個被內部認定有資安風險的模型 Mythos 的技術細節,第二次洩漏了旗艦產品的完整原始碼。

我做了 14 年品牌,看過太多品牌定位和實際品質脫節的案例,當「安全」從工程文化變成行銷標語,它就失去了約束力。

台灣很多公司也是一樣的狀況,ISO 認證掛在牆上,但內部流程根本沒在遵守,認證和文化是兩回事。Anthropic 有全世界最好的安全研究團隊,但安全文化顯然沒有滲透到每一個開發流程,終究還是會有疏忽。

對台灣企業主來說,這件事的教訓很直接:不要因為一家 AI 公司說自己很安全就相信,要看他們出事之後怎麼處理。而 Anthropic 的處理方式是說「人為錯誤,非安全漏洞」,50 萬行原始碼流出,被 fork 10 萬多次,他們不認為這是安全漏洞。

這個態度本身,就是最大的 AI 資安風險警訊。

| 時間 | Anthropic 洩漏事件 | 影響 |

|---|---|---|

| 2026/3/27 | 近 3000 份內部文件外洩,含 Mythos 模型技術細節 | 未公開模型的能力和風險評估曝光 |

| 2026/3/31 | Claude Code 原始碼經 npm 套件外洩,50 萬行程式碼 | GitHub 2 小時破 5 萬星,最終超過 14.5 萬星、10 萬 forks,社群發展出 clean-room 重寫版本 |

| 2026/4/1 | Anthropic 聲明「人為錯誤,非安全漏洞」 | Bloomberg 報導 Anthropic 正在搶救,但程式碼已無法收回 |

| 2026/4/1 | Anthropic 向 GitHub 發出 DMCA takedown,要求移除 8100+ 個 fork | 同日又發部分撤回,僅保留對主 repo 和 96 個特定 fork 的下架請求,其餘恢復 |

Anthropic 官方最新回應:DMCA 下架、部分撤回、承諾改善(4/2 更新)

這篇文章初次發布後,Anthropic 有了進一步的動作,以下是截至 2026 年 4 月 2 日的最新進展。

Anthropic 的 DMCA 連環操作:先全面下架,再部分撤回

3 月 31 日洩漏當天,Anthropic 就向 GitHub 發出了 DMCA takedown 請求,要求移除主 repo 和它的數萬個 fork。

但社群的反應比 Anthropic 的法務快得多,claw-code 在洩漏後 2 小時就突破 5 萬星,最終超過 14.5 萬星和 10 萬 forks,而且已經從單純備份演變成 Python 和 Rust 的 clean-room 重寫專案。聲明裡寫得很直接:「The entire repository is infringing. Reported content must be removed.(整個儲存庫皆構成侵權,被檢舉的內容必須移除。)」

但隔天 4 月 1 日,Anthropic 又發了一份部分撤回通知,只保留對主 repo 和 96 個特定 fork 的下架請求,其餘被連帶下架的 repo 要求 GitHub 恢復。

這個操作很耐人尋味,先用網路級 takedown 把整個 fork 網絡一次掃掉,再撤回大部分,只留最關鍵的幾個。

講白了,Anthropic 知道 10 萬個 fork 不可能全部追殺,所以策略性地挑了 96 個最完整的備份來處理。

但更麻煩的是,社群已經不滿足於保存洩漏的原始碼了,韓國開發者 Sigrid Jin 主導的 claw-code 專案已經發展成 clean-room 重寫,用 Python 和 Rust 重新實作 Claude Code 的架構模式,刻意避開直接複製原始碼。

這種做法在法律上比單純 fork 更難追究,因為 clean-room 重寫是軟體產業行之有年的合法做法。

Anthropic 的 AI 資安風險回應:三個問題沒回答

BleepingComputer 的報導提到,Anthropic 承諾將實施預防措施防止類似事件再發生,但到目前為止,沒有公開任何具體方案。

三個關鍵問題 Anthropic 還沒回答:

第一,KAIROS、Dream Mode、Undercover Mode 這些在洩漏原始碼裡被發現的未上線功能,到底是什麼狀態?是實驗性質還是準備上線?Anthropic 一個字都沒提。

第二,Fortune 報導指出 2025 年 2 月就發生過一次幾乎一模一樣的 Claude Code 打包洩漏,同樣的錯誤一年後再犯一次,中間到底有沒有改過發版流程?

第三,LayerX Security 研究員 Roy Paz 在 Fortune 的報導裡指出,洩漏的程式碼可能讓競爭對手逆向工程 Claude Code 的系統架構,甚至找到繞過安全防護的方法,Anthropic 對這個風險沒有任何公開評估。

老實說,「承諾改善」這四個字在企業公關裡等於什麼都沒說,台灣企業主看到這種回應,應該把它跟你自己公司出包後的態度對比一下,你的客戶會接受「我們會改善」但不說怎麼改嗎?

Anthropic 洩漏事件對台灣企業主的 AI 資安風險啟示

寫這篇不是要叫你不用 AI,2026 年了,不用 AI 的公司已經在落後。

但這次 Anthropic 洩漏事件提醒了一件事:你信任的 AI 供應商,不一定值得你的信任。不是因為他們壞,是因為他們也是人組成的公司,也會犯錯,也會在壓力下妥協。

台灣目前 36% 的企業在導入 AI 時完全沒做過安全評估,數位部已經禁止公務機關使用 DeepSeek,但問題不只是「禁哪一家」。

號稱最安全的 Anthropic 一週都能出包兩次,代表沒有任何一家 AI 公司可以讓你完全放心。

判斷一家 AI 公司可不可靠,不要看他們的品牌宣言寫了什麼,看他們出事之後怎麼面對。有沒有公開透明地說明原因?有沒有具體的改善措施?還是像 Anthropic 這樣,50 萬行 Claude Code 原始碼流出,卻說不算安全漏洞?

你現在可以做的一件事:打開你公司正在用的所有 AI 工具清單,問自己一個問題。

如果這家公司明天洩漏了你的資料,你有什麼備案?如果答案是沒有,那你的 AI 資安風險比你想像的大得多。核心資料保留本地備份、合約裡注意資料可攜性條款、定期檢查服務條款有沒有改。這些事不難,但大多數人都沒做。

AI 時代最大的風險不是 AI 本身,是你以為品牌大就等於安全。Anthropic 洩漏事件證明了,在這個產業,你的判斷力才是唯一可靠的護城河。

推薦閱讀

Sora 關閉的 3 大教訓:企業如何避開 AI 工具風險,不再花冤枉錢

AI 資安自主找出 500 個零日漏洞,黑帽駭客門檻歸零的警訊

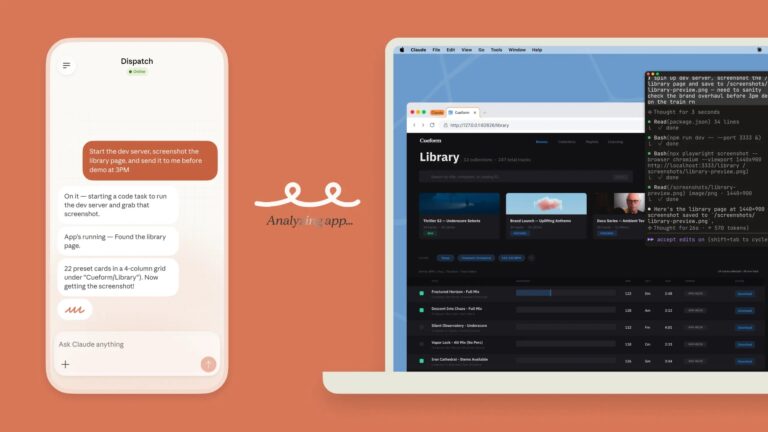

Claude Dispatch 是什麼?手機遙控電腦 AI 自動化,龍蝦被 Anthropic 做成產品

參考資料

BleepingComputer (2026). “Claude Code source code accidentally leaked in NPM package”

Bloomberg (2026). “Anthropic Rushes to Limit Leak of Claude Code Source Code”

VentureBeat (2026). “Claude Code’s source code appears to have leaked: here’s what we know”

Futurism (2026). “Anthropic Has Been Boasting About How Much Its Development Now Relies on Claude”

WaveSpeedAI (2026). “Claude Code Leaked Source: BUDDY, KAIROS & Every Hidden Feature Inside”

Sigrid Jin / ultraworkers (2026). “Rewriting Project Claw Code — Clean-room Python & Rust rewrite”

GitHub DMCA (2026). “Anthropic DMCA Takedown Notice – March 31, 2026”

GitHub DMCA (2026). “Anthropic Partial Retraction – April 1, 2026”

FAQ

Anthropic 洩漏了什麼?Claude Code 原始碼外洩的範圍有多大?

2026 年 3 月 31 日,Anthropic 的 Claude Code npm 套件意外夾帶了 .map 除錯檔案,導致約 1900 個檔案、50 萬行 TypeScript 原始碼完整外洩。被 GitHub 用戶 fork 超過 10 萬次,包含未上線功能 KAIROS、Dream Mode、Undercover Mode 的完整程式碼。

Claude Code 原始碼洩漏的原因是什麼?

根據 Anthropic 官方聲明,這是發版打包時的人為錯誤,工程師忘記排除 source map 檔案。Anthropic 強調這不是駭客攻擊,也沒有客戶資料外洩,但完整的產品架構和未發布功能已經無法收回。

Anthropic 洩漏事件中的 KAIROS 是什麼?

KAIROS 是 Claude Code 原始碼中發現的未上線功能,名字來自古希臘語「關鍵時刻」。它是一個持續運作的背景代理模式,每 5 分鐘自動巡邏程式碼、找錯修錯,還能發送推播通知。代表 AI 正在從被動工具轉變為主動運作的數位員工。

這次 AI 資安風險事件對台灣企業有什麼影響?

台灣目前 36% 企業導入 AI 時完全沒做過安全評估。Anthropic 洩漏事件證明,即使是標榜「最安全」的 AI 公司也會出包。台灣企業主應該盤點正在使用的 AI 工具、確認資料備份和可攜性條款,不要因為品牌大就完全放心。

Anthropic 洩漏後企業該如何評估 AI 供應商的資安風險?

不要只看品牌宣言,要看出事後的處理方式。確認三件事:核心資料是否有本地備份、合約裡是否有資料可攜性條款、服務條款有沒有定期更新通知。另外也要注意 AI 供應商的成長速度,成長最快的公司往往內部流程最混亂。

Claude Code 原始碼中的 Dream Mode 代表什麼 AI 資安風險?

Dream Mode 讓 AI 在用戶停止使用後,於背景整合白天的觀察、移除矛盾、轉化成確定事實。這代表 AI 不只是讀取你的資料,而是在「理解」你的工作模式。企業在評估 AI 工具時,需要清楚知道自己的資料被處理到什麼程度。