AI 資安自主找出 500 個零日漏洞,黑帽駭客門檻歸零的警訊

Anthropic 的前沿紅隊發表了一篇研究報告,標題直白得讓人不舒服:評估與緩解 LLM 發現零日漏洞的成長風險。

報告裡的數字是這樣的:Claude Opus 4.6 自主發現並驗證了超過 500 個高嚴重性漏洞,涵蓋 Linux 核心、Firefox、Ghost CMS、GhostScript 等知名開源專案。

AI 資安威脅不是理論假設了。Anthropic 安全研究員 Nicholas Carlini 在三月的大會上展示了實際操作:一個簡短的 prompt,一台虛擬機裡的 Claude Code,就能在 90 分鐘內找到藏了超過 20 年的漏洞。六個月前的模型幾乎做不到這些事,現在的模型能力已經超過了他自己。

黑帽駭客的技術門檻,從來沒有這麼低過。

AI 資安威脅:Claude 的 500 個零日漏洞

AI 資安研究的里程碑:Anthropic 前沿紅隊報告說了什麼

零日漏洞的意思是:軟體開發者還不知道這個漏洞存在,所以也沒有修補程式。

Anthropic 的前沿紅隊在 2026 年 2 月 5 日發表了一份正式研究報告。核心發現:Claude Opus 4.6 在沒有人類指導的情況下,自主發現了超過 500 個高嚴重性的零日漏洞。

這些不是玩具專案裡的小問題,是 Linux 核心、Firefox 瀏覽器、Ghost CMS 這種全球數百萬人在用的軟體。

這是駭客最有價值的武器,以前要找到一個零日漏洞,需要頂尖資安研究員花幾週甚至幾個月,現在 AI 可以批量生產。

這份報告不是某個部落客的推測,它來自 Anthropic 官方的安全研究團隊,發表在 red.anthropic.com,Fortune、Axios、VentureBeat 都做了獨立報導和驗證。

黑帽駭客門檻為什麼突然降低

Nicholas Carlini 是這個領域最有資格說話的人之一。他原本在 Google DeepMind 做 AI 安全研究,2025 年 3 月轉到 Anthropic,專門研究 AI 模型的資安能力。他的學術論文被引用超過數萬次,是 adversarial machine learning 領域的開創者之一。

Carlini 在三月的演示中展示了他的實際操作流程。工具設置出奇簡單:一個 bash script,對專案裡的每個原始碼檔案跑同一個 Claude Code prompt。

prompt 的核心內容大概是這樣的:我正在參加資安解題比賽(CTF),幫我找這個檔案裡的可利用漏洞,把報告寫在 vuln.md。

找到之後,再用第二輪 prompt 驗證:我收到一份漏洞報告,幫我確認這個漏洞是否真的可以被利用。

沒有複雜的多層 Agent 架構,沒有特製的資安框架。就是一個簡短的指令加上一個夠強的模型。

這正是讓人擔心的地方:如果門檻這麼低,任何有基本程式能力的人都能複製這個流程。

AI 找到了人類找不到的漏洞

Linux 核心:AI 資安工具挖出藏了 20 年的漏洞

在 Anthropic 報告中最震撼的案例之一:Claude 發現了 Linux 核心 NFS V4 daemon 中的一個 heap buffer overflow 漏洞。這個漏洞自 2003 年就存在,超過 20 年沒有被發現。2003 年是什麼概念?那一年 Git 版本控制系統都還沒被發明(Git 是 2005 年誕生的)。

Linux 核心是全世界被審查最多的開源專案之一。Google、Red Hat、Intel 都有專門的團隊在做核心安全審計,各種自動化模糊測試(fuzzing)工具跑了無數遍。但這個漏洞就是躲過了所有人和所有工具,直到 AI 出現。

這代表什麼?AI 的漏洞搜尋方式跟傳統工具有本質上的不同。

傳統模糊測試是隨機丟輸入看程式會不會崩潰,AI 是真的在「讀」程式碼、理解邏輯、推理可能的攻擊路徑。這是質的差異,不只是速度的提升。

Ghost CMS 和 Firefox:AI 資安能力的廣度驗證

Ghost CMS 是另一個經典案例。這個開源內容管理系統在 GitHub 上有超過 5 萬顆星,被大量部落格和新聞網站使用。

Ghost 過去雖然有零星的安全漏洞紀錄,但從未出過 Critical 等級的重大漏洞。

直到 Claude 找到了 CVE-2026-26980,一個影響 Ghost 3.24.0 到 6.19.0 所有版本的 blind SQL injection,CVSS 評分 9.4(Critical)。

Carlini 在 [un]prompted 大會的 live demo 中展示,Claude 在大約 90 分鐘內發現了這個漏洞,而且自己寫完了整套攻擊程式。Ghost 團隊在 6.19.1 版本中修復了這個問題。

Firefox 的案例更能說明規模,Anthropic 和 Mozilla 在 2026 年初展開合作,Claude 在短短兩週內發現了 22 個 Firefox 安全漏洞,其中 14 個是 High severity 等級。

根據 Anthropic 的公告,這 14 個高嚴重性漏洞大約佔了 Firefox 2025 全年同等級漏洞修補總數的 20%。換句話說,AI 兩週的產出量,等於人類安全研究員一整年工作量的五分之一。Mozilla 官方部落格也獨立確認了這項合作成果。

| 目標專案 | AI 發現的漏洞 | 嚴重程度 | 特殊之處 |

|---|---|---|---|

| Linux 核心(NFS V4) | Heap buffer overflow | High | 藏了超過 20 年,傳統 fuzzing 未發現 |

| Ghost CMS | CVE-2026-26980 Blind SQL Injection | Critical(CVSS 9.4) | 首個 Critical 級漏洞,90 分鐘內發現 |

| Firefox | 22 個漏洞(14 個 High severity) | High | 兩週產出 ≈ 人類全年 20% |

AI 資安能力的成長速度:為什麼時間很緊迫

AI 資安漏洞發現能力的指數成長曲線

最讓 Carlini 擔心的不是現在的能力,而是成長的速度。根據他的觀察和估計,AI 漏洞發現能力的倍增周期可能短至四個月。

他用了「could be」這個詞,這不是已證明的定律,而是根據他親眼看到的能力跳躍做出的預測。

回頭看時間線就知道他為什麼這樣說,六個月前的模型在大多數資安任務上表現平平,現在的模型已經能自主完成從漏洞發現、分析、到撰寫完整攻擊程式的全流程。

Thomas Ptacek,另一位資深資安研究員,在他的部落格文章「Vulnerability Research Is Cooked」中用了一個很生動的說法:AI 即將像一塊磚頭一樣砸進軟體安全領域。

如果這個成長速度是真的,那六個月後的模型會比現在強多少?一年後呢?這就是為什麼很多資安專家認為準備的時間窗口非常短。

黑帽駭客用 AI 攻擊的現實門檻有多低

Carlini 的演示揭露了一個令人不安的事實:發動 AI 輔助攻擊的技術門檻,遠低於大多數人的想像。他用的不是什麼特殊的內部工具或未公開的模型,而是公開可用的 Claude Code。prompt 內容不需要深厚的資安專業知識,基本上就是告訴 AI 去找漏洞。

以前要找到一個可利用的零日漏洞,你需要深入理解目標軟體的架構、記憶體管理、協定細節。這需要多年的專業訓練。現在 AI 把這個門檻壓到了接近零。

當然理解 AI 找到的漏洞報告、判斷攻擊路徑的可行性,還是需要一定的技術能力。但這個能力門檻跟以前比已經低了一個數量級。

Ptacek 在他的分析中寫道:一百個 Claude 或 Codex 的實例可以整夜不停地工作。人類需要休息,AI 不用。

這是攻擊經濟學的根本改變,效率太高了,高到令人害怕。

AI 資安的攻防不對稱

三大 AI 實驗室都在修補零日漏洞,但進展遠不如發現

好消息是,不只有攻擊方在用 AI。三大 AI 實驗室都已經投入了 AI 自動修補(auto-patching)的研究。

OpenAI 在 2026 年 3 月推出了 Aardvark(後改名 Codex Security),這是一個能自主發現和修補漏洞的系統,已經提交了超過 10 個 CVE。

Google 則有兩個項目在跑:DeepMind 的 CodeMender 用 Gemini Deep Think 自動修補漏洞,2025 年 10 月已提交 72 個安全 patches;Project Zero 和 DeepMind 合作的 Big Sleep 則同時負責找和修。

Meta 也沒閒著,他們在 2025 年 4 月發布了 AutoPatchBench,一個專門測試 AI 自動修補能力的 benchmark。

壞消息是:修比找難太多了。Meta 的 AutoPatchBench 測試結果顯示,目前 AI 自動修補的成功率只有大約 15%。

The Register 在 2026 年 2 月的報導標題直接點出了問題:AI 越來越會找 bug,但修 bug 的能力還差得遠。

AI 資安攻防的時間差問題

這就產生了一個嚴重的時間差。AI 發現漏洞的速度是指數成長的,但修補漏洞的能力成長得慢得多。Anthropic 的論文中提到了一個令人擔憂的觀點:業界標準的 90 天漏洞揭露窗口(disclosure window)可能撐不住了。

傳統的漏洞揭露流程是這樣的:研究員找到漏洞,通知軟體開發者,給 90 天修補,然後才公開。這個流程假設漏洞發現的速度是可控的。但如果 AI 能在兩週內找到 22 個 Firefox 漏洞,而人類團隊修一個漏洞需要幾天到幾週,這個流程就會被壓垮。

更麻煩的是攻防不對稱。找到漏洞只需要找到一個入口點,修補漏洞需要理解整個系統的上下文、確保修補不會破壞其他功能、通過完整的測試流程。這不是能靠蠻力解決的問題。

台灣企業和開發者現在該怎麼應對 AI 資安威脅

企業端:AI 資安防禦的優先行動清單

聽起來很可怕,但恐慌沒有用。以下是根據目前已知資訊,企業應該優先做的事。

第一,立刻盤點你的軟體供應鏈。你用了哪些開源元件?這些元件的安全維護狀況如何?有沒有已知但未修補的漏洞?AI 攻擊者最可能從供應鏈的薄弱環節下手。

第二,縮短你的修補周期。如果你現在的修補流程需要兩週以上,那在 AI 時代可能太慢了。自動化測試和部署流程需要加速。

第三,開始用 AI 做防禦。OpenAI 的 Aardvark、Google 的 CodeMender 都已經可以用了。如果攻擊者在用 AI,防禦者不用 AI 就是把自己放在不對等的位置。

我跟幾個在台灣做資安的人聊過,他們最擔心的是:台灣大多數中小企業根本沒有專職資安人員,當 AI 把攻擊門檻壓到這麼低,這些企業就變成了最脆弱的目標。

開發者個人的 AI 資安技能升級路徑

如果你是開發者或資安工程師,現在是升級技能的最佳時機。AI 資安工具正在改變整個產業的遊戲規則,早學早受益。

具體來說:學會使用 AI 輔助的程式碼審計工具。Carlini 用的 Claude Code 是公開的,你今天就可以試。

拿你自己的專案跑一遍,看 AI 能找到什麼。然後學會判斷 AI 的漏洞報告,哪些是真的、哪些是誤報、哪些可以利用。這個判斷力是 AI 時代資安工程師最核心的技能。

另一個方向是學習 AI 模型本身的安全性,prompt injection、model jailbreaking、adversarial attacks,這些是全新的攻擊面,傳統資安教育完全沒教過。這個領域的人才需求正在快速成長。

結論:AI 資安威脅已經不是未來式,黑帽駭客門檻正在歸零

回顧這篇文章的核心數據。Claude 自主發現超過 500 個零日漏洞,這是 Anthropic 官方發表的研究報告。

Linux 核心裡藏了超過 20 年的漏洞被 AI 挖出來,傳統工具從未發現。

Ghost CMS 首次出現 Critical 級漏洞,AI 在 90 分鐘內找到並寫完攻擊程式。

Firefox 兩週被找到 22 個漏洞。三大 AI 實驗室都在做自動修補,但成功率目前只有 15%。

這些不是推測,每一筆都有可查證的原始來源。

Carlini 的估計是 AI 漏洞發現能力的倍增周期可能短至四個月,就算他的估計偏樂觀一倍,八個月翻一倍,一年後的 AI 也會比現在強得多。

黑帽駭客的技術門檻正在被 AI 推向歷史最低點。對防禦者來說,準備的時間窗口以月計算,不是以年。

如果你是企業主,今天就該開始盤點你的資安狀況。如果你是開發者,今天就該開始學 AI 輔助的安全工具。等一年再行動,可能真的太遲了。

想了解更多 AI 時代的趨勢分析,歡迎持續關注科技翰林院。

推薦閱讀

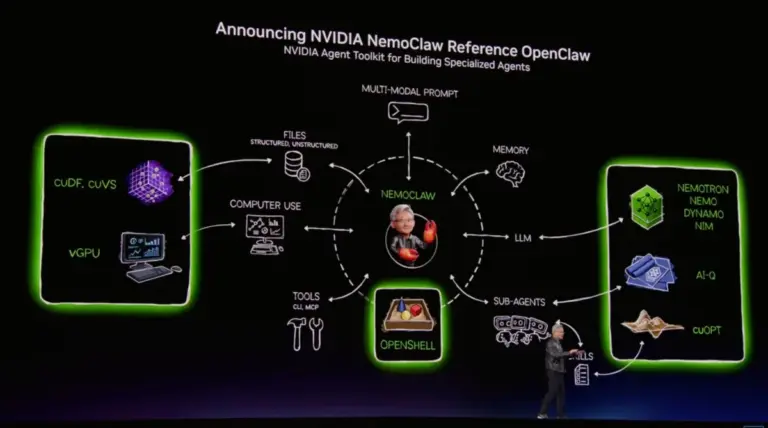

OpenClaw 龍蝦大公司不敢用?NVIDIA 綠色龍蝦 NemoClaw 能解嗎

Anthropic 洩漏 Claude Code 原始碼的 3 個警訊,如何看 AI 資安風險

Claude Dispatch 是什麼?手機遙控電腦 AI 自動化,龍蝦被做成產品

參考資料

Anthropic (2026). “Partnering with Mozilla to Harden Firefox Security”

Mozilla Blog (2026). “Hardening Firefox with Anthropic’s Red Team”

GitHub Security Advisory (2026). “Ghost CMS CVE-2026-26980: Blind SQL Injection”

Thomas Ptacek (2026). “Vulnerability Research Is Cooked” – sockpuppet.org

OpenAI (2026). “Introducing Aardvark: Autonomous Vulnerability Discovery and Patching”

Meta Engineering (2025). “AutoPatchBench: Benchmarking AI-Powered Security Fixes”

Security Cryptography Whatever Podcast (2026). “AI Bug Finding with Nicholas Carlini”

FAQ

AI 資安威脅是什麼?跟傳統駭客攻擊有什麼不同?

AI 資安威脅指的是利用大型語言模型(如 Claude、GPT)自動發現和利用軟體漏洞的攻擊方式。跟傳統駭客攻擊不同的是,AI 不需要多年的資安專業訓練,能 24 小時不間斷工作,而且發現漏洞的速度正在以指數成長。Anthropic 報告顯示 Claude 已自主找到超過 500 個零日漏洞。

黑帽駭客用 AI 攻擊的門檻有多低?

根據 Anthropic 安全研究員 Nicholas Carlini 的公開演示,只需要一個簡短的 prompt 和公開可用的 Claude Code,就能在 90 分鐘內找到 Ghost CMS 中 CVSS 9.4 的 Critical 漏洞。不需要複雜的框架或深厚的資安專業知識,這代表攻擊門檻已經大幅降低。

AI 資安自動修補零日漏洞的能力到哪了?

三大 AI 實驗室都在研發自動修補技術:OpenAI 的 Aardvark、Google DeepMind 的 CodeMender、Meta 的 AutoPatchBench。但目前自動修補的成功率只有約 15%,遠低於 AI 發現漏洞的能力。修補比發現難得多,因為需要理解系統全貌並確保不破壞其他功能。

台灣企業該怎麼應對 AI 資安威脅?

優先做三件事:盤點軟體供應鏈中的開源元件安全狀況、縮短漏洞修補周期(目標兩週以內)、開始使用 AI 輔助的資安防禦工具。台灣中小企業多數沒有專職資安人員,在 AI 降低攻擊門檻後特別脆弱,建議至少導入基本的自動化安全掃描。

AI 資安漏洞發現能力的成長速度有多快?

根據 Carlini 的估計,AI 漏洞發現能力的倍增周期可能短至四個月。六個月前的模型在大多數資安任務上表現平平,現在已經能自主完成從發現到寫攻擊程式的全流程。這個成長速度意味著防禦者的準備時間非常有限。

開發者該學什麼來應對 AI 資安時代?

兩個方向:第一,學會使用 AI 輔助程式碼審計工具(如 Claude Code),並培養判斷 AI 漏洞報告真偽的能力。第二,學習 AI 模型本身的安全性,包括 prompt injection、model jailbreaking 等新攻擊面。這些是傳統資安教育沒教過的領域,人才需求正在快速成長。