AI PC 不再是行銷話術:離線本地 AI 真的能跑,這對台灣企業意味著什麼

2024 年 CES,滿場都在喊 AI PC,每家筆電品牌的攤位都掛著這三個字,好像不加上去就落伍了。

問題是,沒人說得清楚 AI PC 到底能幹嘛?背景模糊?視訊自動字幕?這些功能十年前就有了,換個名字重新包裝一次,台灣老闆不會買單的,我當時在 CES 報導裡看完一輪,心裡的結論很直接,時機未到。

一年多後,我改觀了。

YouTuber 林亦 LYi 在 2026 年 3 月發了一支評測影片,用消費級硬體跑了 3970 億參數的千問 3.5 大模型。不是跑個 demo 截圖,是真的能對話、能推理、能用。

加上因為龍蝦 OpenClaw 讓 Mac mini 賣到斷貨,這件事讓我重新想了一下:AI PC 從話術變成現實,中間到底發生了什麼?更重要的是,這跟台灣企業主有什麼關係?

AI PC 從噱頭到現實:到底發生了什麼事

2024 年的 AI PC 是什麼?老實說就是筆電多了一顆 NPU

CES 2024 那陣子,AI PC 這個詞被用到爛,每家都說自己是 AI PC,但你問他 AI 在哪,答案通常是:我們內建了一顆 NPU。

NPU 是什麼?神經網路處理器,專門跑 AI 運算的晶片。聽起來很厲害,實際上 2024 年的 NPU 能做的事很有限。Windows 拿它來跑背景模糊、降噪、自動字幕,就這樣。這些功能用 CPU 也跑得動,只是比較耗電。

AMD 的 Lisa Su 在 CES 2024 說了一句很大的話:「Every PC sold will be an AI PC.」當時聽起來像是行銷部門寫的稿。不是她說錯,是時間還沒到。硬體到位了,但軟體和模型都還沒準備好,NPU 基本上是一顆裝在筆電裡的裝飾品。

我那時候跟幾個做 AI 的朋友聊,大家反應一致,顯卡就夠用了,沒有覺得一定要買 AI PC。

2025-2026 年的 AI PC 不一樣了:本地 AI 真的能跑大模型

2025 到 2026 年,三件事同時到位,局面就完全不同了。

第一,模型變小了。不是功能縮水,是透過量化技術把模型壓縮,從幾十 GB 壓到幾 GB,品質幾乎沒掉。

第二,記憶體變大了,消費級硬體的統一記憶體從 16GB 跳到 64GB、128GB。

第三,硬體架構到位了。不只是晶片變快,而是 CPU、GPU、記憶體之間的資料搬運方式徹底改變。

這三件事加在一起,結果就是林亦 LYi 那支影片裡展示的:他用 Apple M5 Max、NVIDIA GB10、AMD AI MAX+ 395 玲瓏星核,三台消費級機器跑千問 3.5,一個 3970 億參數的大模型,不是跑不動硬撐,是真的能用,甚至接近雲端 AI 的速度。

講白了,2024 年的 AI PC 是把 AI 當標籤貼在筆電上,2026 年的 AI PC 是真的能在你桌上跑一個完整的大語言模型,不用連網,不用付月費,資料不會流出你的辦公室,完全離線運行,這差別很大。

為什麼本地 AI 突然變得可行:不是硬體變強,是模型變聰明

AI PC 能跑大模型的關鍵不是算力,是量化技術

很多人以為本地跑 AI 就是拚硬體,顯卡越貴越好、記憶體越大越好,這只對了一半。

真正的突破在模型那一端,量化技術讓模型瘦身瘦到消費級硬體吃得下。拿 Q4 量化來說,原本一個 26GB 的模型可以壓到 8GB 左右,品質只掉大約 5%,對大多數應用場景來說,這 5% 的差距你根本感覺不出來。

千問 3.5 更聰明的地方是它的 MoE 架構,全名是 Mixture of Experts,帳面上 3970 億參數,聽起來嚇人,但它每次推理只啟動其中 170 億參數。打個比方,這就像一間公司有 3970 個員工,但每個案子只派 170 個最適合的人去做,效率高,資源省。

這兩個技術疊在一起,結果就是:你不需要一台幾十萬的伺服器,一台十幾萬的桌機就能跑夠用的大模型。

我去年幫一個做進出口的朋友測試本地跑 Meta Llama 3 處理報關文件,他最驚訝的不是速度,是這東西不用上網就能用。對很多台灣中小企業來說,他們要的功能其實不複雜,資料不外流這件事本身就很有價值,也會讓資安部門放心。

統一記憶體讓 AI PC 跨過了最後一道門檻

模型瘦身解決了一半的問題,另一半是記憶體。

過去你要在本地跑 AI,最大的瓶頸是顯卡記憶體,NVIDIA RTX 4090 已經是消費級頂規了,也才 24GB VRAM,一個稍微大一點的模型就塞不進去,塞不進去怎麼辦?切成好幾塊分批載入,速度直接慢到不能用。

統一記憶體改變了這件事。不管是 Apple 的 M 系列、NVIDIA 的 GB10、還是 AMD 的 Ryzen AI Max+,現在三家都做到 128GB 統一記憶體。統一記憶體的意思是 CPU 和 GPU 共用同一塊記憶體,不用來回搬資料,模型直接整塊塞進去跑。

NVIDIA 的 Jensen Huang 在 GTC 2025 講了一句話,這次不像行銷話術:「Every data scientist, every AI researcher, and every student can now have an AI supercomputer.」翻譯就是:現在不管是數據科學家、AI 研究員還是學生,每個人都能擁有一台 AI 超級電腦。

他說的就是這件事,過去只有企業機房才能跑的模型,現在放在你桌上就能跑。

話說回來,128GB 夠不夠?跑千問 3.5 的 Q4 量化版大約需要 80-90GB,128GB 剛好夠用還有餘裕,不過如果模型繼續長大,這個天花板遲早會碰到,但至少在 2026 年,128GB 是一個讓本地 AI 從勉強能跑變成舒服能用的分水嶺。

三大玩家的 AI PC 佈局:他們看到的未來不一樣

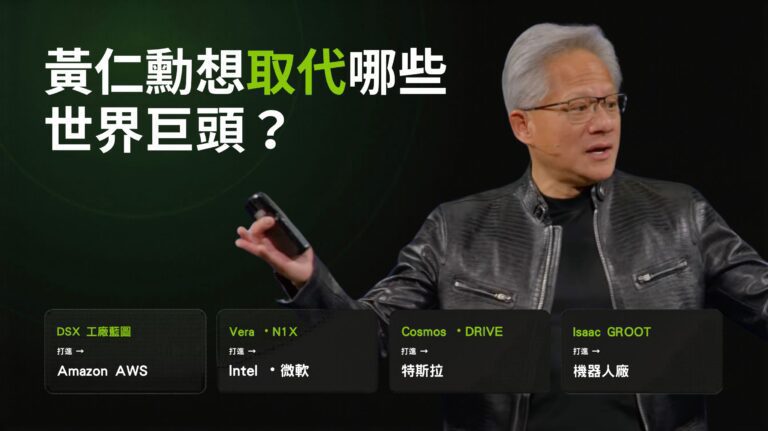

NVIDIA 的本地 AI 野心:從賣顯卡到賣桌上型超級電腦

NVIDIA 靠賣 GPU 給雲端大廠賺了天文數字的錢,為什麼還要做本地 AI 硬體?

邏輯很簡單:雲端市場有天花板,本地市場是另一塊餅,GB10,也叫 Project DIGITS,定價 3000 美元,配 128GB 統一記憶體,能跑 200B 參數的模型。黃仁勳把它定位成桌上型 AI 超級電腦,目標客群是開發者、研究人員、還有想在本地測試模型的企業。

說真的,3000 美元換一台能跑大模型的桌機,對台灣的 AI 新創或研究單位來說不算貴。

過去要做同樣的事,你得租雲端 GPU,一個月燒好幾萬,現在一次買斷,資料還不用上傳雲端,NVIDIA 的算盤是:先用本地硬體把開發者圈進來,這些人未來上線部署還是會回到 NVIDIA 的雲端生態系。

Apple 的 AI 路線:隱私不是口號,是產品策略

Apple 做本地 AI 的邏輯跟 NVIDIA 完全不同。

Craig Federighi 在 WWDC 講過一句定調的話:「能在本地跑的,就應該在本地跑。」Apple Intelligence 的架構很清楚,先在裝置上處理,本地搞不定的才送到 Private Cloud Compute,而且送上去的資料 Apple 自己也看不到。

從 M1 晶片開始就在鋪統一記憶體的路,四年前的架構設計,現在拿來跑本地 AI 剛好收割,這也是龍蝦 OpenClaw 讓 Mac mini 賣到斷貨的主要原因,M5 Max 配統一記憶體,在測試裡跑千問 3.5 的表現很突出,證明 Apple 路線其實沒有錯。

對台灣企業主來說,Apple 這條路線最大的吸引力是不用想太多,你不需要懂什麼量化技術、什麼 MoE 架構,買一台 Mac,Apple Intelligence 幫你處理,資料留在機器裡,雖然 Apple 在 AI 時代被大家一直嫌棄擠牙膏,但硬體實力 Apple 真的是強到沒話說。

AMD 的本地 AI 策略:用性價比搶中間市場

AMD 的策略最直白:你們賣那麼貴,我便宜一半給你同樣的規格。

Ryzen AI Max+ 395 搭 128GB 統一記憶體,價格大約是 NVIDIA GB10 的一半,Lisa Su 在財報會議上講得很明白:AI PC 是 PC 產業目前成長最快的區塊,AMD 要吃的是量。

AMD 的玲瓏星核在測試裡表現不差,跑千問 3.5 能用,雖然速度不是最快,但考慮到價格,性價比很高,對預算有限但想試試本地 AI 的台灣中小企業來說,AMD 可能是最務實的選擇。

不過 AMD 的軟體生態一直是弱項,NVIDIA 有 CUDA,Apple 有自己封閉但完整的生態系,AMD 的 ROCm 到現在還是讓開發者頭痛,硬體性價比再高,如果軟體支援跟不上,用起來就是多一層麻煩。

| 玩家 | 代表產品 | 核心策略 | 目標客群 | 統一記憶體 |

|---|---|---|---|---|

| NVIDIA | GB10 (Project DIGITS) | 用本地硬體圈住開發者,導流回雲端生態系 | AI 開發者、研究人員、新創團隊 | 128GB |

| Apple | M5 Max MacBook / Mac Studio | 隱私優先,本地處理為主,無縫整合自家生態 | 重視隱私的企業用戶、創意工作者 | 128GB |

| AMD | Ryzen AI Max+ 395 玲瓏星核 | 用性價比搶量,降低本地 AI 門檻 | 預算有限的中小企業、想入門的技術團隊 | 128GB |

三家都做到 128GB,但策略方向完全不同。NVIDIA 要的是生態系黏著度,Apple 要的是產品體驗一致性,AMD 要的是市占率。你選哪一家,取決於你在意的是什麼,不是規格表上哪個數字比較大。

雲端 AI 不會消失,但本地 AI PC 解決了雲端解決不了的問題

本地 AI 的真正賣點不是省錢,是資料主權

很多人第一反應是:本地跑 AI 比較省錢吧?

不完全對,本地 AI 真正的殺手鐧是資料主權,你的資料從頭到尾不離開你的機器,這件事在 2026 年變得越來越重要。

歐盟 AI Act 已經正式上路,對高風險 AI 系統的資料處理有嚴格規範,醫療、金融、法律這些產業,資料落地不是選項,是法規要求。

Qualcomm 執行長 Cristiano Amon 講得很直接:「On-device AI means your data never leaves your device.(裝置端 AI 讓你的資料不需上傳雲端,隱私更有保障。)」

對台灣企業主來說這代表什麼?你的客戶名單、報價單、營業秘密,不需要經過任何第三方伺服器,不是你信不信任 OpenAI 或 Google 的問題,是你的客戶信不信任你把他們的資料丟上雲端的問題,大品牌要承受的資安風險太大,不是貴或便宜的問題。

Sam Altman 也承認了:未來是本地 AI 和雲端 AI 共存

連 OpenAI 的老闆都不覺得雲端能吃下全部市場。

Sam Altman 在 2025 年達沃斯論壇說:「I think there will be a world where some AI runs locally and some in the cloud, and the user shouldn’t have to think about it.」翻成人話就是,未來 AI 一部分跑在你桌上,一部分跑在雲端,你根本不用管它在哪裡跑。

這段話很有意思,OpenAI 的整個商業模式建立在雲端推理上,每一次你用 ChatGPT,他們都在燒 GPU 算力賺你的訂閱費,但連他們都承認,不可能所有 AI 任務都走雲端。有些事情就是得在本地做。

這不是誰輸誰贏的問題,是分工。

這件事離台灣企業主有多近:比你想的更近

AI PC 對台灣企業的實際意義:不是買新電腦,是改變 IT 架構思維

老實說,AI PC 這個詞聽起來像是在叫你換電腦,不是。

它真正改變的是你公司的 IT 架構怎麼想,以前要跑 AI,你得租雲端 GPU,一個月幾千到幾萬塊美金。現在一台配備足夠記憶體的 AI PC,就能在本地跑內部知識庫的 RAG 系統,中小企業搞一台就夠用了。

製造業的場景更直接,產線旁邊放一台跑即時品檢的 AI PC,不需要連網,不怕斷線,延遲低到可以即時反應,我跟幾個做代工的老闆聊過,他們最怕的不是 AI 不準,是網路斷了整條線停擺。

實際上這兩年間還真的有很多因為雲端 AI 或是伺服器當機,導致所有 AI 不能使用,企業停擺的新聞案例。

Gartner 預估 2026 年 AI PC 會佔整體 PC 市場 55%,大約 1.43 億。

本地 AI 的隱藏門檻:硬體買了,然後呢?

不過我得講一個大家不太愛聽的事實。

硬體門檻確實降低了,但問題是你把一台 AI PC 搬進公司,然後呢?模型要選哪個?怎麼部署?跑起來效果不好要怎麼調?模型更新了要不要跟?這些全部需要有人懂。

硬體的門檻降低了,但知識的門檻還在那裡,你不需要博士學位,但至少需要一個搞得懂 LLM 部署的人,這是很多硬體廠商不會跟你講的事情,有高階機器但沒有人會操作,買了可能也長灰塵。

AI PC 會不會是下一個 3D 電視:反面觀點也要聽

本地 AI 的質疑:科技分析師 Benedict Evans 的警告

寫到這裡,我覺得有必要把反面觀點拿出來講。

科技分析師 Benedict Evans 在他的文章裡直接警告,AI PC 有變成下一個 3D 電視的危險,意思是硬體能力先做出來了,但殺手級應用還沒跟上,聽起來刺耳,但他的邏輯值得想一下。

另一個現實是雲端推理的成本正在暴跌,GPT-4o mini、Claude Haiku 這些輕量模型,呼叫一次的成本低到可以忽略,當雲端越來越便宜,本地跑 AI 的成本優勢就在縮小,如果純粹比價錢,雲端可能很快就比本地划算,這還說不準。

我的看法是 AI PC 不會取代雲端,但它打開了雲端打不開的門

話說回來,我自己觀察台灣企業的實際需求,發現成本從來不是第一考量。

隱私、離線、低延遲,這三件事雲端做不到,再便宜也做不到,你不可能叫一個律師事務所把客戶的機密資料丟上 OpenAI 的伺服器去跑分析,你也不可能在沒有網路的工廠產線上用雲端 AI 做品檢。

我自己實際接觸的幾家台灣中小企業,他們對 AI 的第一個問題幾乎都不是多少錢,而是「我的資料會不會外洩」,這個焦慮是真實的,不是被媒體炒出來的。

AI PC 的價值不在比雲端便宜,在做到雲端做不到的事,3D 電視死掉是因為它解決的是一個不存在的問題,但資料隱私和離線運算,是真實存在的需求,這是根本的差別。

2026/4/3:Google Gemma 4 再次證明這條曲線還在加速

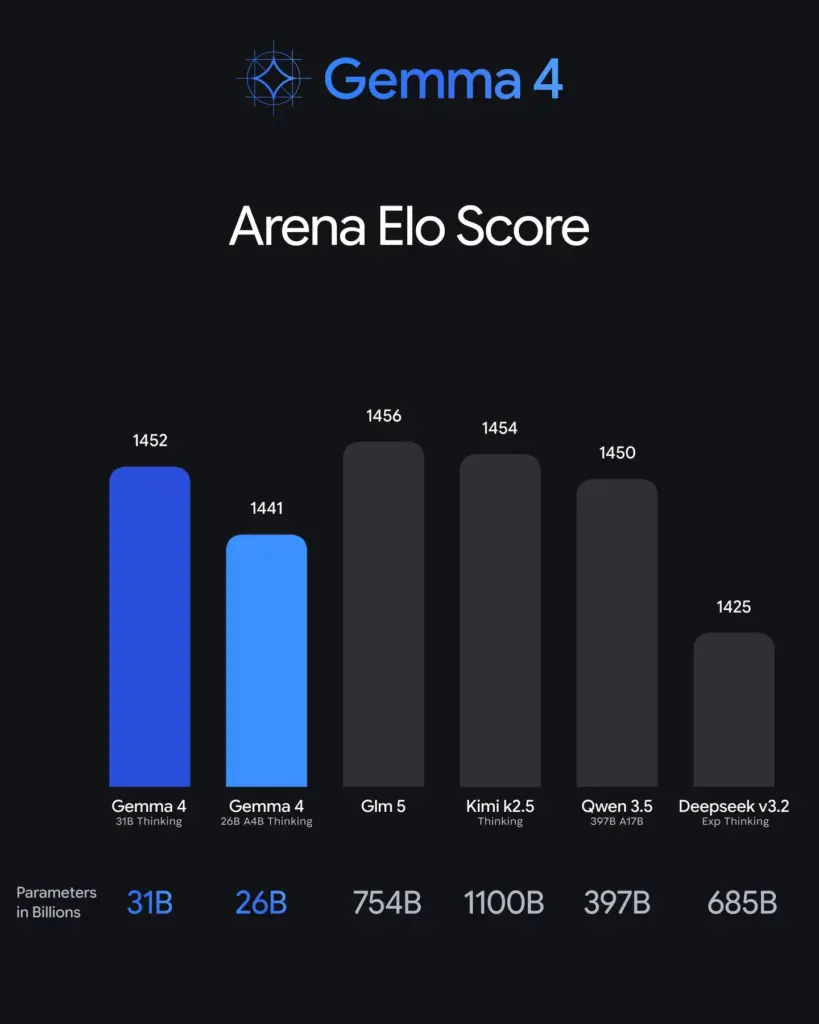

這篇文章發布後不到一天,Google 就釋出了 Gemma 4,一個開源、免費、Apache 2.0 授權的 AI 模型。

它引起關注的原因是一張排行榜:Gemma 4 最大版本只有 310 億參數(31B),但在 Arena Elo 真人盲測排行榜上拿到 1452 分,跟阿里巴巴千問 3.5(3970 億參數,1450 分)、Deepseek v3.2(6850 億參數,1425 分)打成平手甚至更高,體型差了 12 到 22 倍,表現卻一樣。

這件事的實際意義:3970 億參數的模型需要昂貴的伺服器叢集,但 310 億參數的模型可以在一台不到兩萬台幣的 Mac Mini 上跑,不需要網路,不需要月費,資料不出門,Gemma 4 最小的 2B 版本甚至可以在手機上跑。

當然 Arena Elo 是單一指標,衡量的是整體偏好,在複雜程式碼或長篇推理上,大型模型可能還是有明顯優勢。而且這張比較圖來自 Google 官方的行銷素材,自然會挑最有利的數字。

但趨勢本身很清楚:半年前要花大錢在雲端才能用到的 AI 能力,現在可以免費裝在桌上,這條曲線還在往下走。開源模型之爭也是另外一個戰場,我們未來會另外寫一篇完整的 Gemma 4 分析。

結論:AI PC 本地運算的時代真的來了,但重點不是硬體

Gartner 說 2026 年 AI PC 佔市場 55%,這個數字不是預測,是正在發生的事情。

三大晶片廠,NVIDIA、Apple、AMD,技術路線完全不同,但結論一樣:AI 要從雲端走到你桌上。

說真的,AI PC 本地運算不是未來式,是現在進行式,硬體已經到位了,價格也在合理範圍內,但我想對台灣的企業主講一句大實話,真正的問題不是該不該買一台 AI PC,是你的公司準備好讓 AI 在本地跑了嗎?

你有沒有人懂得選模型、部署模型、維護模型?你的內部資料有沒有整理成 AI 可以讀的格式?你的團隊知不知道本地 AI 能幫他們做什麼?

花錢買硬體是最簡單的那一步,真正的門檻是組織和知識,把資料清洗完之後,設計一個屬於你們的工作流程。

買一台 AI PC 放在辦公室裡不會自動讓你的公司變聰明,就像買一台 Mac Pro 不會自動讓你變成剪接師。

科技翰林院會持續追蹤 AI PC 和本地運算的發展,幫你把技術翻成人話,有新的重要變化,我們會第一時間分析。

推薦閱讀

GTC 2026 黃仁勳 1 兆美元訊號:OpenAI 甩迪士尼,流向 NVIDIA

MCP 是什麼?一篇搞懂 Model Context Protocol 跟你有什麼關係

Vibe Coding 是什麼?AI 寫程式的新方法完整解析

參考資料

林亦LYi (2026). “本地AI哪家强?统一内存大横评!”

NVIDIA (2025). “NVIDIA Puts Grace Blackwell on Every Desk and at Every AI Developer’s Fingertips”

Apple (2024). “Introducing Apple Intelligence for iPhone, iPad, and Mac”

AMD (2025). “AMD Ryzen AI Max+ 395 Processor”

Gartner (2025). “Gartner Says AI PCs Will Represent 31% of Worldwide PC Market by End of 2025”

Benedict Evans (2025). “AI and the PC refresh cycle”

Google (2026). “Introducing Gemma 4”

FAQ

AI PC 是什麼?

AI PC 是內建專用 AI 處理單元(NPU)的個人電腦,能夠直接在機器上執行 AI 模型,不需要連到雲端。跟傳統電腦最大的差別是,它有專門為 AI 運算設計的硬體,像是 NVIDIA 的 GPU、Apple 的 Neural Engine、Qualcomm 的 Hexagon NPU。簡單講,就是一台自己就能跑 AI 的電腦。

本地 AI 跟雲端 AI 差在哪?

最大的差別是資料在哪裡跑。雲端 AI 是把你的資料送到遠端伺服器運算,本地 AI 是直接在你的電腦上跑,資料不出門。本地 AI 的優勢是隱私好、不怕斷網、反應快。雲端的優勢是運算能力強、不受硬體限制。兩者是互補關係,不是取代關係。

AI PC 需要多少記憶體才夠跑大模型?

看你要跑什麼模型。跑 7B 參數的模型大概需要 16GB 記憶體,跑 13B 以上建議 32GB 起跳。如果是統一記憶體架構(Apple Silicon、NVIDIA GB10),效率更高,同樣容量能跑更大的模型。一般企業用途 32GB 是比較安全的起點,想跑百億參數以上的模型建議 64-128GB。

統一記憶體是什麼?跟一般記憶體有什麼不同?

傳統電腦的 CPU 記憶體和 GPU 記憶體是分開的,資料要在兩邊搬來搬去,浪費時間也浪費頻寬。統一記憶體是讓 CPU 和 GPU 共用同一塊記憶體,資料不用搬,直接存取。Apple M 系列和 NVIDIA GB10 都用這個架構。對 AI 運算來說特別重要,因為大模型要吃大量記憶體,統一架構讓有限的記憶體發揮最大效率。

台灣買得到 NVIDIA GB10 嗎?

NVIDIA Project DIGITS(搭載 GB10)售價 3000 美金,約台幣 96000 左右。台灣目前還沒有正式通路販售,但 NVIDIA 官網有開放預購登記。如果急著用本地 AI,Apple Mac 系列和搭載 AMD Ryzen AI Max+ 的迷你主機是現在就買得到的選項。

AI PC 適合什麼樣的企業使用?

三種企業最適合:處理敏感資料的產業(法律、醫療、金融),需要離線或低延遲的場景(製造業產線品檢、門市即時推薦),以及已經在用 AI 工具但擔心資料外洩的中小企業。如果你的公司只是偶爾用 ChatGPT 寫寫信,暫時不需要特別投資 AI PC,現有的雲端服務就夠用。