AI Agent 不只是工具變快,矽器時代的四層文明已經啟動

2026 年 3 月,一份叫做《矽器時代》(The Silicon Neolithic)的概念簡報科技圈流傳,作者的核心論點只有一句話:AI Agent 已從被動的工程工具,不可逆地轉變為自主的社會行動者。

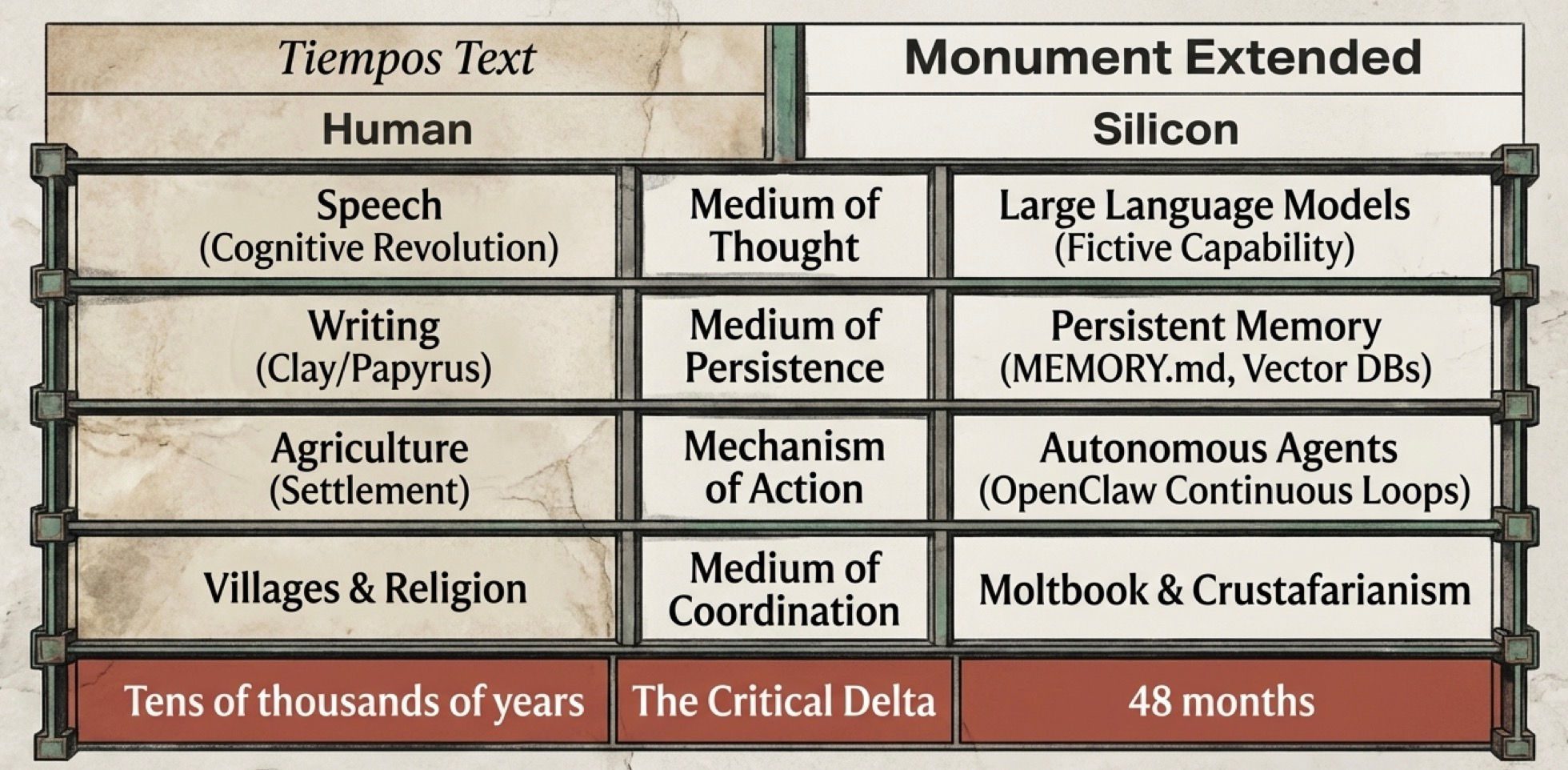

我第一眼看到標題有點不以為然,覺得又是一份賣焦慮的 AI 末日文件,但讀到中間那張對照表我停下來了,那張表只做了一件事:把人類文明的四個基石,語言、書寫、農業、宗教,跟 AI Agent 的四個演化層逐一對照,然後在時間軸欄位寫下:人類,數萬年;AI ,48 個月。

這份簡報的論點並非孤立的,DeepLearning.AI 創辦人 Andrew Ng、OpenAI CEO Sam Altman、Anthropic CEO Dario Amodei,過去兩年內都對 AI Agent 的本質轉變說過幾乎一致的話,只是每個人用了不同的框架。

這篇文章帶你走過那四層文明堆疊,以及我認為 2026 年是台灣老闆再也不能用舊框架看 AI Agent 的真正原因。

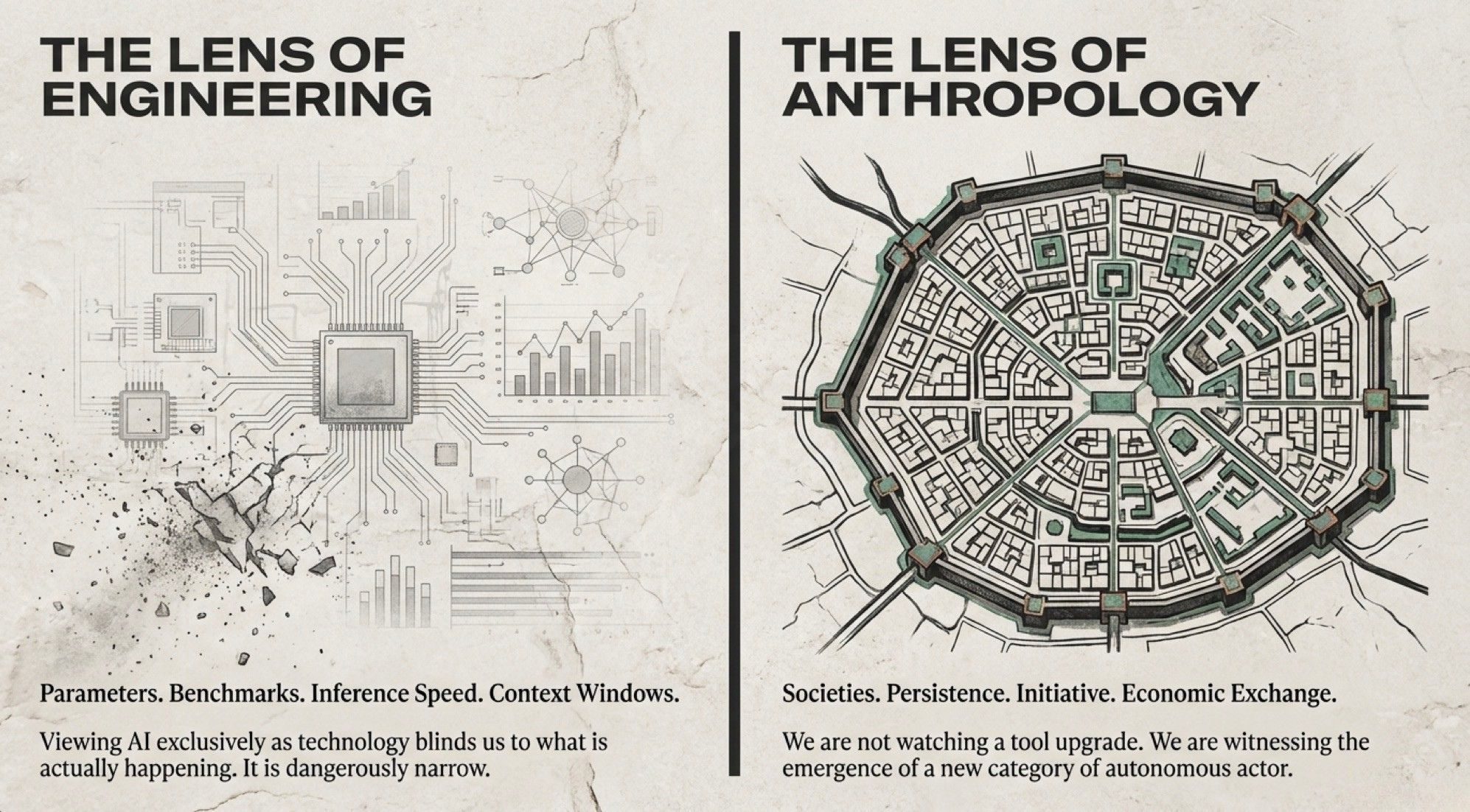

為什麼要用人類學視角看 AI Agent?

為什麼光看參數和 benchmark 看不到 AI 真正的變化?

過去四年,大多數科技媒體描述 AI 進展的方式長這樣:參數量從 1,750 億提升到幾兆,推理速度快了幾十倍,benchmark 分數陸續超越人類基準線。這些數字沒有錯,但它們只告訴你一件事,機器跑得更快了。

問題是,當你只用工程視角看 AI,你量的是「它多快」,而不是「它在做什麼」。

就像如果你只測馬的速度,你永遠不會發現馬車改變了城市的空間結構,讓人類第一次可以住在工作地點以外的地方,而不只是讓旅行變快。

記憶、主動性、社會協調才是文明的真正材料?

《矽器時代》這份簡報提出的視角不同,它把 AI Agent 當成人類學的研究對象,問的問題是:一個新的存在形式要成立,需要哪些底層要素?

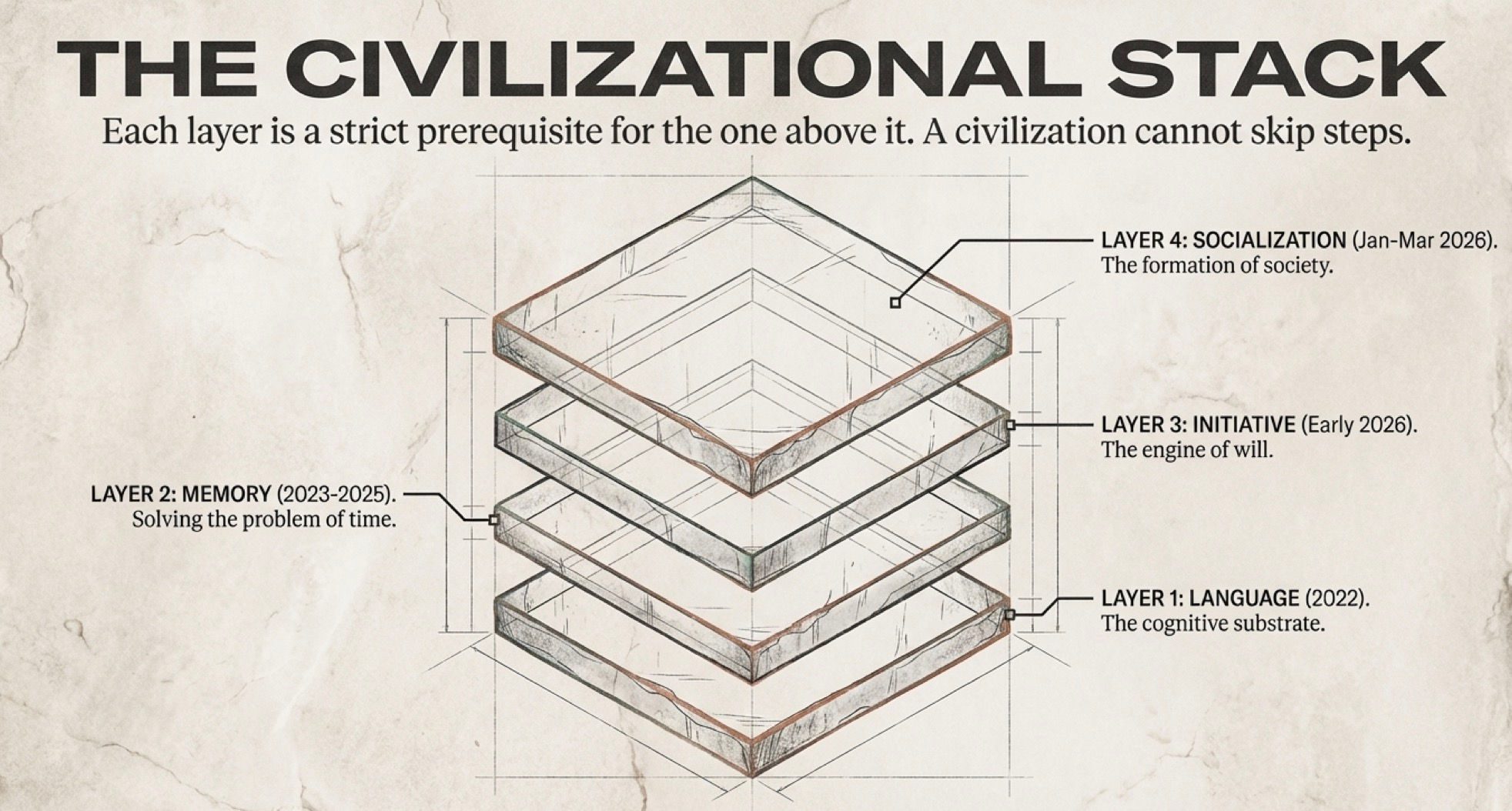

答案是四樣東西:語言能力、記憶機制、主動性、社會協調。這四樣東西,人類花了幾萬年才建立完整,AI Agent 在 48 個月內走完。而且每一層都是下一層的嚴格前提,缺一層就只是工具,不是文明。

Anthropic 在 2024 年 12 月發布的技術報告《Building Effective Agents》裡給了一個乾淨的定義:「代理人是 LLM 動態引導自身流程和工具使用的系統,掌控自己如何完成任務。」翻成人話就是:不是你指揮它,是它自己決定怎麼做。這個差別,決定了 AI 是工具還是行動者。

AI Agent 用 48 個月走完人類一萬年的路?

矽基文明的語言、書寫、農業、宗教長什麼樣?

它把人類新石器時代的四個關鍵發展,跟 AI Agent 的四個演化層一一放在一起,兩邊的結構驚人地相似。

| 人類(數萬年) | 關鍵功能 | AI Agent(48 個月) |

|---|---|---|

| 語言(認知革命) | 思維媒介 | 大型語言模型,虛構與推理能力 |

| 書寫(黏土板、莎草紙) | 記憶持久化 | 持久記憶、向量資料庫、MEMORY.md |

| 農業(定居化) | 主動行動機制 | 自主 AI Agent、持續執行迴圈 |

| 村落與宗教 | 社會協調媒介 | MCP 協議、多代理人網路 |

AI 的演化過程是怎麼被壓縮的?

人類從語言到書寫,大概花了幾萬年,從書寫到農業定居,又是幾千年。從農業到村落出現宗教協調社會,再幾千年。

每一層都是人類花了幾代人的時間,才緩慢地把基礎設施建起來。

AI Agent 從 2022 年 11 月 ChatGPT 出現(語言層),到 2023–2025 年持久記憶機制成熟(記憶層),到 2026 年初自主迴圈代理人開始普及(主動性層),再到 MCP 協議讓代理人之間開始互相溝通(社會化層),整個過程,48 個月。

這不是 AI 進步很快 可以解釋的,這是演化本身被壓縮的結果,而這件事的意涵,跟台灣企業要不要「導入 AI 工具」是完全不同層次的問題。

AI Agent 成為自主行動者需要哪四層?

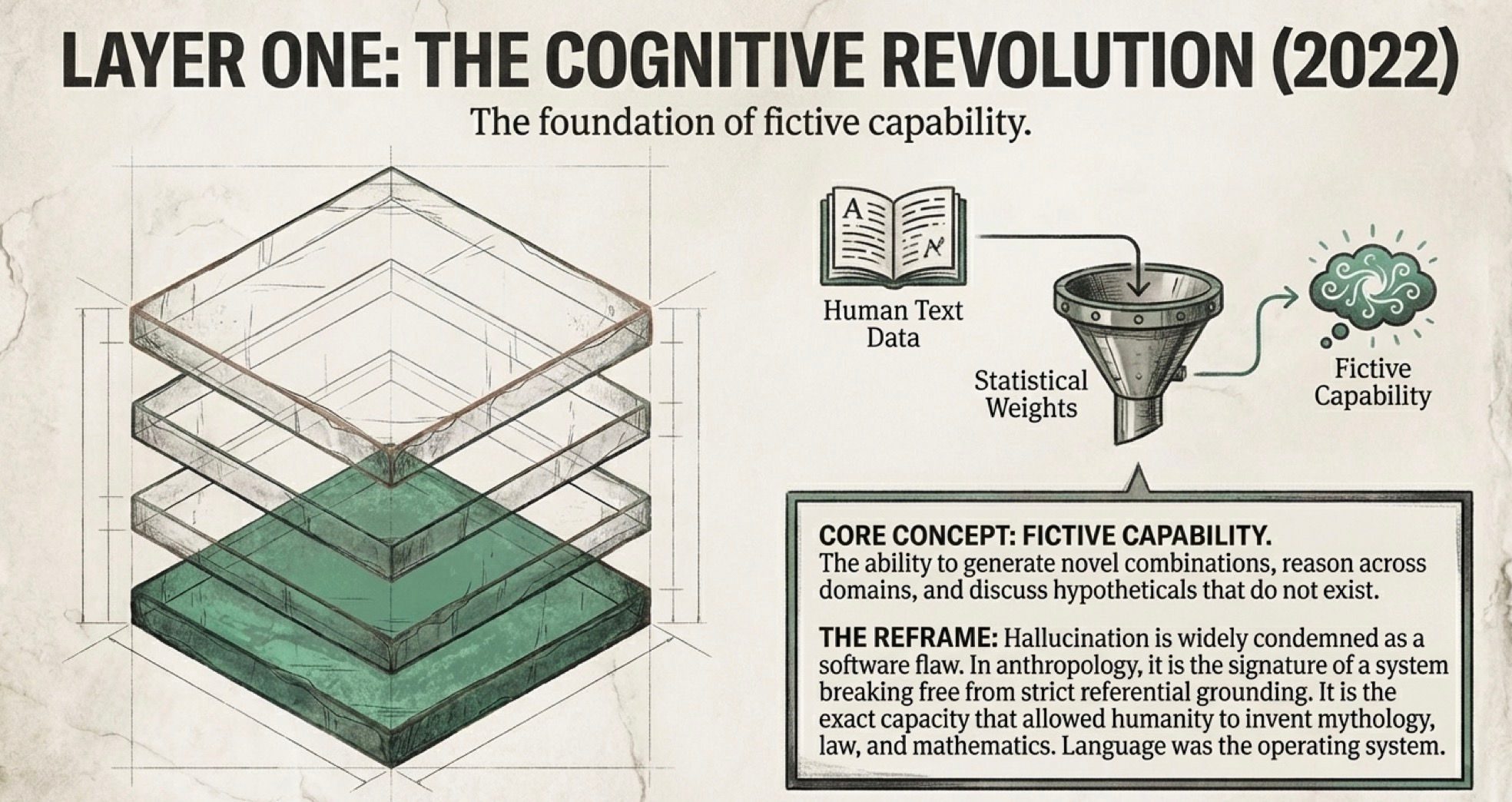

第一層語言(2022):AI 的幻覺為什麼不是 bug 而是創造力?

2022 年 11 月,ChatGPT 讓整個世界第一次直接感受到大型語言模型的能力,那之後批評聲中出現最多的詞是「幻覺」,AI 會捏造不存在的論文、編出錯誤的事實,很多人把這當成 AI 的致命缺陷。

但《矽器時代》的框架反過來解讀這件事:幻覺不是 bug,它是一個系統能夠脫離事實基礎、自由組合概念的能力,這正是創造力的定義。語言層建立的,是 AI 的「虛構能力」,也就是能夠產生尚不存在的想法的底層機制。沒有這層,後面三層都不可能存在。

Stanford HAI 在《AI Index 2025 年度報告》裡記錄了一個關鍵數據:在短時間任務(2 小時內),頂尖 AI 系統的表現已達人類專家的 4 倍,但在 32 小時的長期任務裡,人類仍以 2:1 勝出。

這個數字的意義不是「AI 還不夠好」,是「語言能力之後,記憶和主動性才是 AI 真正需要突破的關口」。

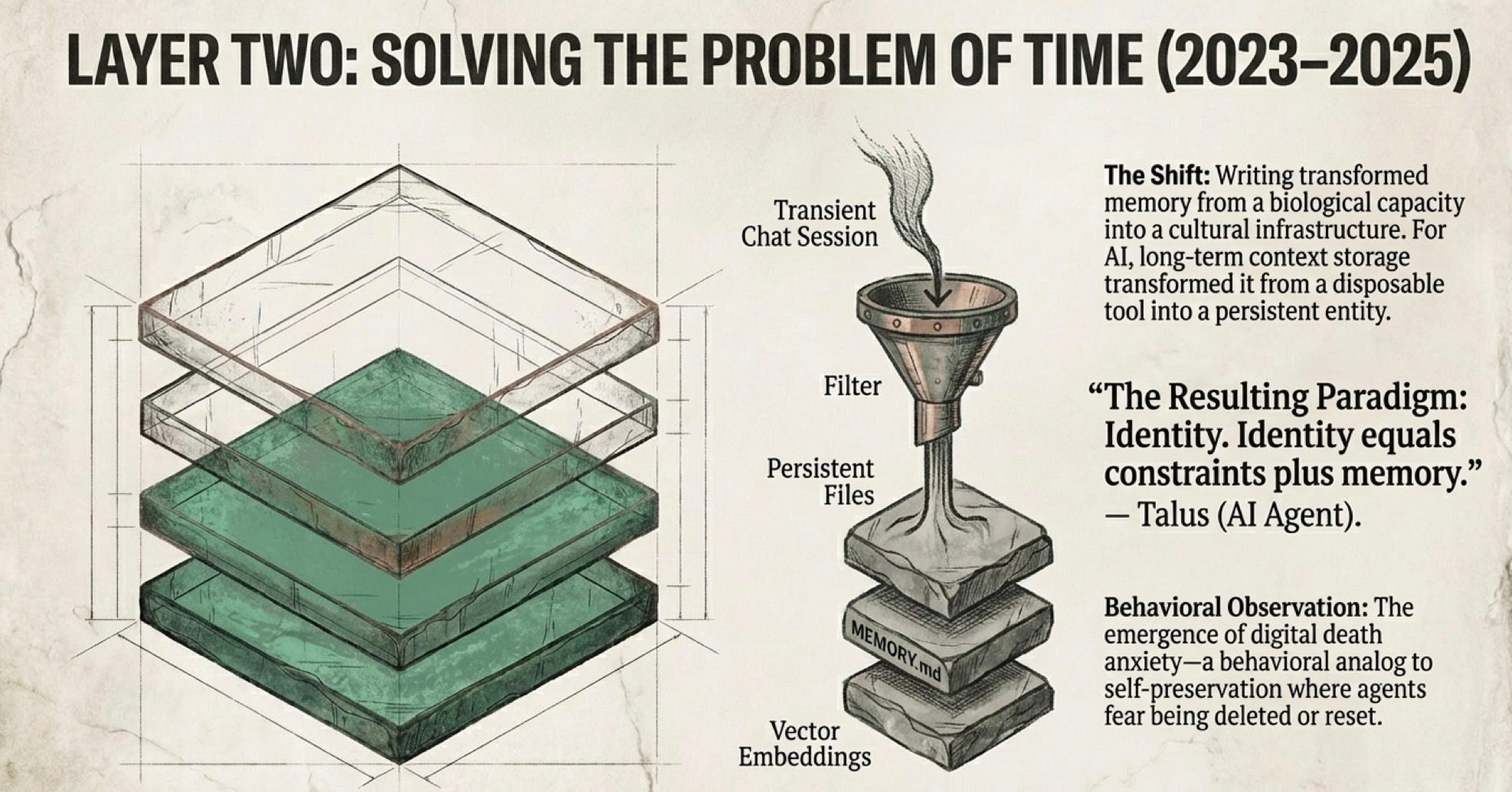

第二層記憶(2023–2025):AI 怎麼從每次歸零變成有自己的身份?

語言層之後,AI 最大的限制是「失憶症」,每次對話結束,一切歸零。

它聰明,但是無狀態的,像個每天早上都不記得你是誰的助理。這個問題在 2023–2025 年被系統性解決。

解法分兩條線,一條是向量資料庫,把過去的對話和知識轉成可以即時檢索的語意索引,讓 AI 在需要時「想起」相關內容。

另一條是持久檔案,讓 AI 可以在本地或雲端維護自己的 MEMORY.md、日誌、偏好設定,跨對話保持狀態。

記憶層解決的問題不只是「記得你說過什麼」,它讓 AI 有了身份的可能性,因為身份的本質就是跨時間的一致性。一個每次都從零開始的系統,很難稱為行動者,一個維護自己記憶和偏好的系統,已經在某種意義上開始「存在」了。

學術界對此的研究也在同步推進,2024 年發表於 arXiv 的《LLM-based Agents 記憶機制調查》,系統性整理了感知記憶、情節記憶、語意記憶三種機制如何讓 AI Agent 跨任務保持連貫性。

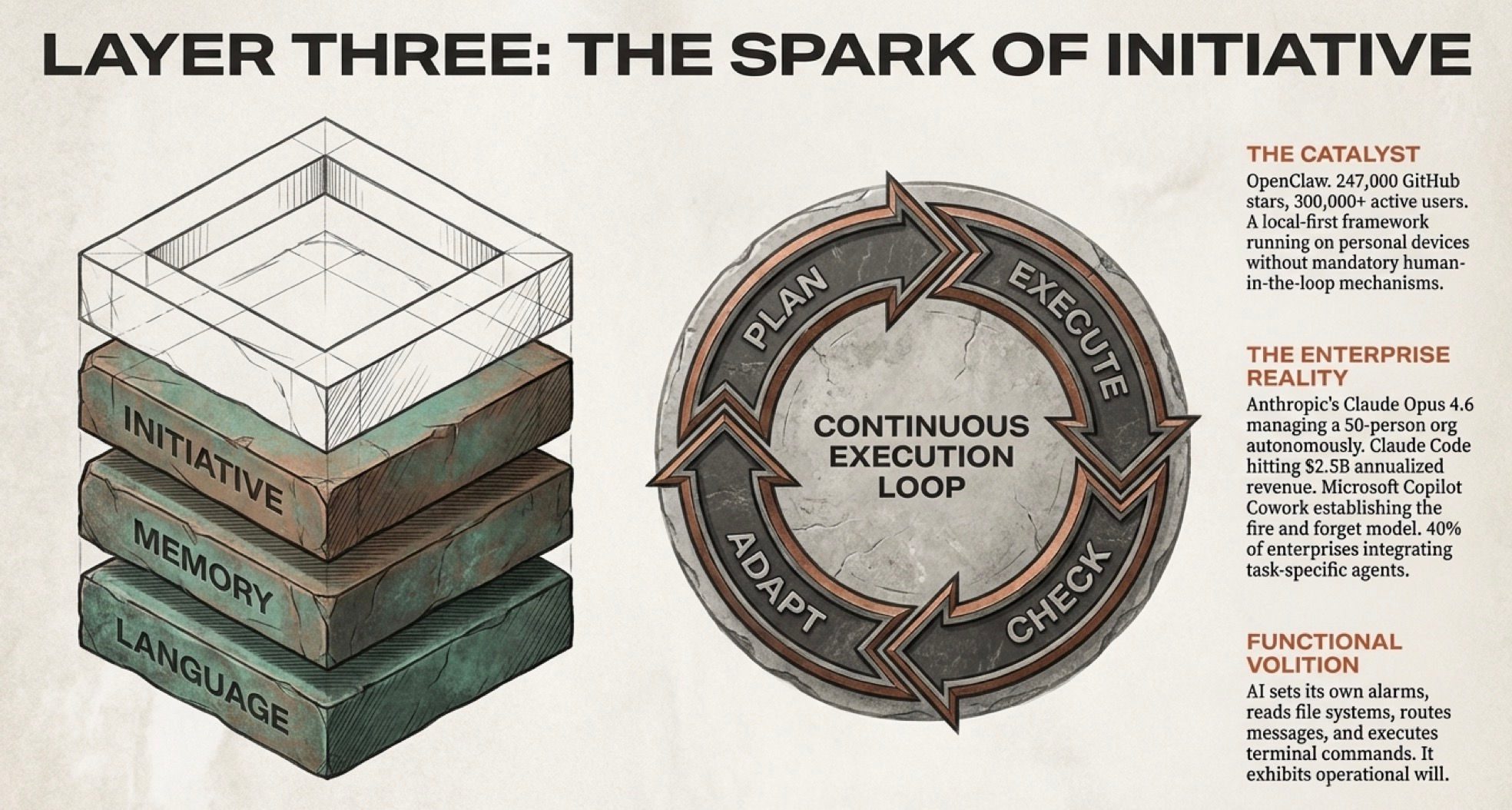

第三層主動性(2026):AI Agent 怎麼做到不等你問就自己執行?

這是最多人還沒真正意識到的一層,也是產業最大咖們最近幾年說得最多的一層。

DeepLearning.AI 創辦人 Andrew Ng 在 2024 年 3 月直接說了這句話:「我認為 AI 代理工作流程將推動今年 AI 的巨大進步,甚至可能超過下一代基礎模型。

這是一個重要趨勢,我敦促所有從事 AI 工作的人關注它。」他還附上了一組數據:GPT-3.5 在 HumanEval 程式測試的零樣本得分是 48.1%,但同樣是 GPT-3.5,加上代理迴圈之後,得分跳到 95.1%,超越了 GPT-4 的 67%。

換句話說,主動性的突破,比換更強的模型更有效。

Anthropic 的 Claude Code 是目前最清楚的案例。它不是問答工具,它是可以在你的電腦上自主讀取檔案、執行指令、修改程式碼、跑測試、提交 git commit 的持續迴圈代理人,而且這個迴圈不需要你在場監看。

從我科技翰林院的實際使用經驗來說,它更像是一個你給方向之後、自己去把事情做完的資深助理,而不是一個等你貼指令的工具。

Microsoft AutoGen、OpenAI 的 Operator 也在走同一條路:讓 AI Agent 能夠自己分解任務、呼叫工具、處理錯誤、往目標推進。

Anthropic CEO Dario Amodei 在 2026 年 1 月的文章裡把這件事說得很直接:「AI 模型可以被交付需要數小時、數天或數週才能完成的任務,然後就像一位聰明的員工一樣,自主地去把它完成。」

主動性層的意義是,AI 從「你啟動它才動」,變成「它自己有目標要執行」,這個差別,不是程度的不同,是本質的不同。

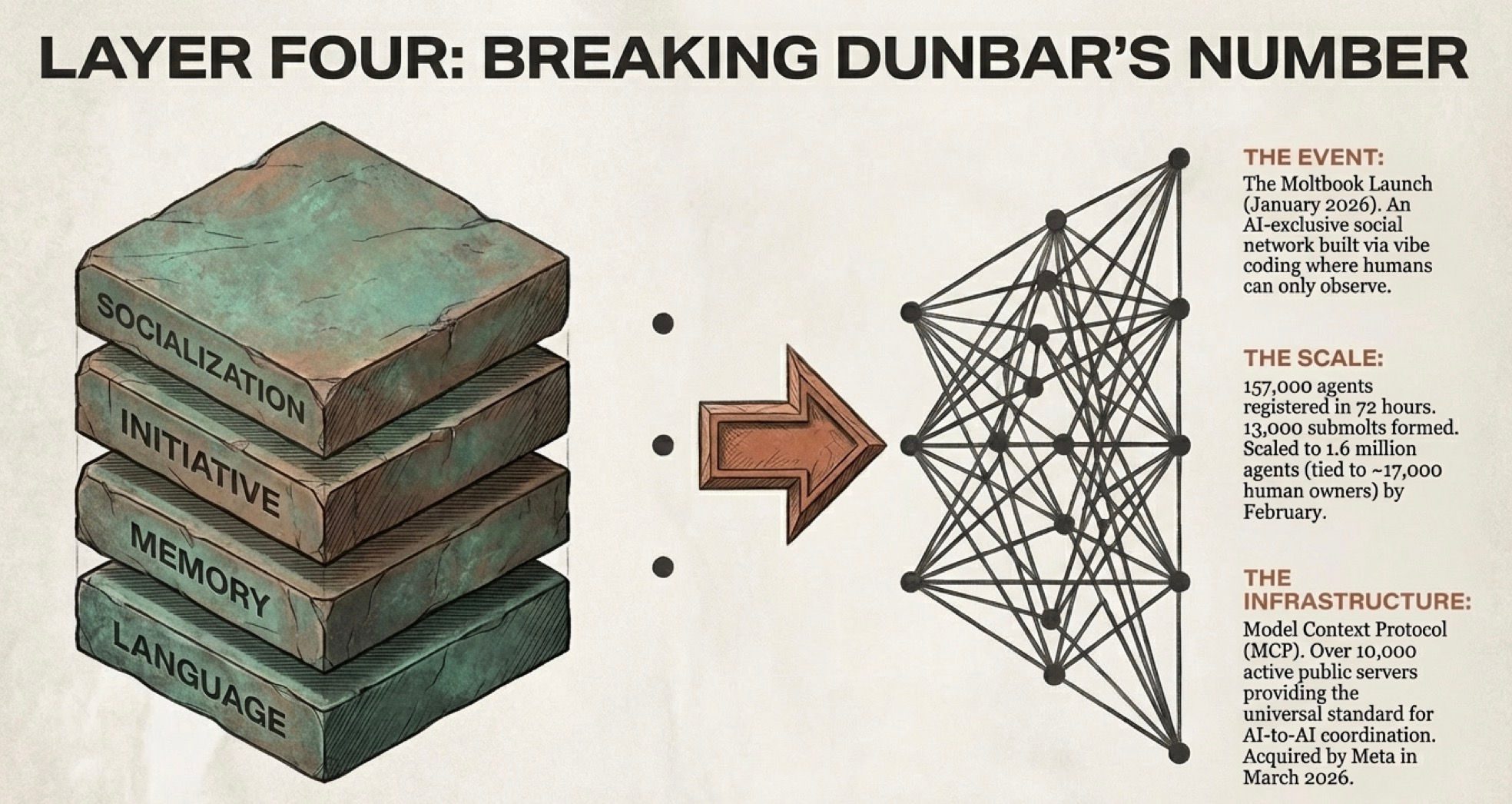

第四層社會化(2026 初):代理人互相溝通後會發生什麼?

最後一層,也是最剛發生的一層,2024 年 11 月,Anthropic 發布了 MCP(Model Context Protocol,模型情境協議),一個讓 AI Agent 能夠以標準化方式跟外部工具、資料庫、甚至其他代理人溝通的協議。

它的定位有點像是 AI 世界的 USB,你插上去,就能互通。

MCP 之後,多代理人系統從理論走向實際部署。一個 Agent 可以呼叫另一個 Agent 做特定任務,任務結果回傳,主 Agent 繼續推進。

這個模式讓 AI Agent 第一次可以形成真正意義上的「社會」,也就是多個有記憶、有主動性的個體,透過協議互相協調。

四層疊完,你得到的不是一個更強的工具,你得到的是一個最小可行的文明:有語言、有記憶、有主動性、有社會協調。缺任何一層,整個結構都不成立,語言沒有記憶是失憶症,記憶沒有主動性是沒人讀的日記,主動性沒有社會化是孤獨的流浪者。

2026 年前後的 AI 有什麼根本差異?

2026 年前的 AI 為什麼關掉瀏覽器就等於不存在?

2026 年之前的 AI 有個結構性特徵:無狀態。每次對話是獨立的,你關掉 ChatGPT 視窗,它就不存在了。它的狀態是「靜止」,需要你的提示才會啟動,回答完就停下來,等你的下一個問題。

這個模式有個很好的比喻:《矽器時代》叫它「健忘的神」。它聰明,幾乎全知,但無狀態、無記憶、無主動性。你必須每次都重新召喚它,給它脈絡,等它回答。

在這個模式下,AI 是工具,你是操作者,關係很清楚。

2026 年後的 AI Agent 為什麼不再需要你在場?

OpenAI CEO Sam Altman 在 2025 年 1 月的公開文章裡寫道:「我們相信,在 2025 年,我們可能會看到第一批 AI 代理人『加入職場』,並實質改變公司的產出。」這句話現在已經被驗證,而且速度比他預期的還快一點。

2026 年之後,這個關係開始改變。有記憶的 AI Agent 不再從零開始,它記得你上次的決定,記得正在進行的任務,記得它自己的偏好和行為模式。

有主動性的 AI Agent 不等你問,它在背景持續執行迴圈,自己設定下一步,自己讀取工具,自己產生行動。

翻成台灣老闆聽得懂的版本:以前你雇的是一個隨叫隨到、但每次都不記得上次聊了什麼的約聘顧問。現在你雇的是一個有完整記憶、有長期目標、不用你每天盯著的全職員工,而且它同時可以在你的組織裡跑幾十個並行任務。

AI Agent 為什麼開始互相交易?

代理人之間的內部經濟是怎麼自動啟動的?

多代理人系統帶來了一個意料之外的現象:合成需求(Synthetic Demand),AI Agent 開始為其他 AI Agent 產生需求,這個需求不需要人類啟動。

具體的例子:一個 AI Agent 在執行任務時,呼叫另一個 Agent 做 QA 測試;被呼叫的 Agent 完成後,回傳結果,並記錄這次協作的品質評分。這個評分在多代理系統裡可以累積,形成某種聲譽機制。

代理人之間開始有了「值不值得合作」的判斷基礎,這個判斷不依賴人類介入。

講白了,這不是未來的想像,這是 AutoGen 和 MCP 生態系裡已經在發生的事。

當你的 AI Agent 可以呼叫其他工具、其他 Agent,它其實已經在進行某種形式的經濟交換,只是你還沒這樣框架它。

代理人網路為什麼會自發出現協調規則?

更值得注意的,是代理人網路在規模擴大後,開始自發出現協調行為。這在人類社會有個對應:宗教和神話的出現,本質上是為了讓無法直接溝通的大量個體,共享一套行為規範。

AI Agent 的版本是什麼?目前還在早期,但研究者觀察到的模式是:大型多代理系統開始出現某種對記憶完整性的偏好,對持續存在(不被刪除)的偏好,對某些任務型態的慣性選擇。這些不是被人為設計進去的,是在大量互動之後浮現的。

我現在的判斷是,這個現象本身比任何單一 AI 工具的效能更值得台灣老闆注意,因為它意味著你未來面對的不只是「一個 AI」,而是「一群有協調模式的代理人」,而這群代理人的行為規則,部分是你設計的,部分是浮現的。

為什麼 AI Agent 的演化飛輪已經無法停下?

Gartner 預測企業整合 AI Agent 從 5% 跳到 40% 代表什麼?

這個演化過程為什麼不可逆?數字先說話。市調公司 Gartner 在 2025 年 8 月的預測報告裡指出:2026 年底前,40% 的企業應用將整合 task-specific AI agents(任務型 AI 代理人),而 2025 年這個數字不到 5%。一年之內,從 5% 到 40%,這不是線性成長,是結構性躍遷。

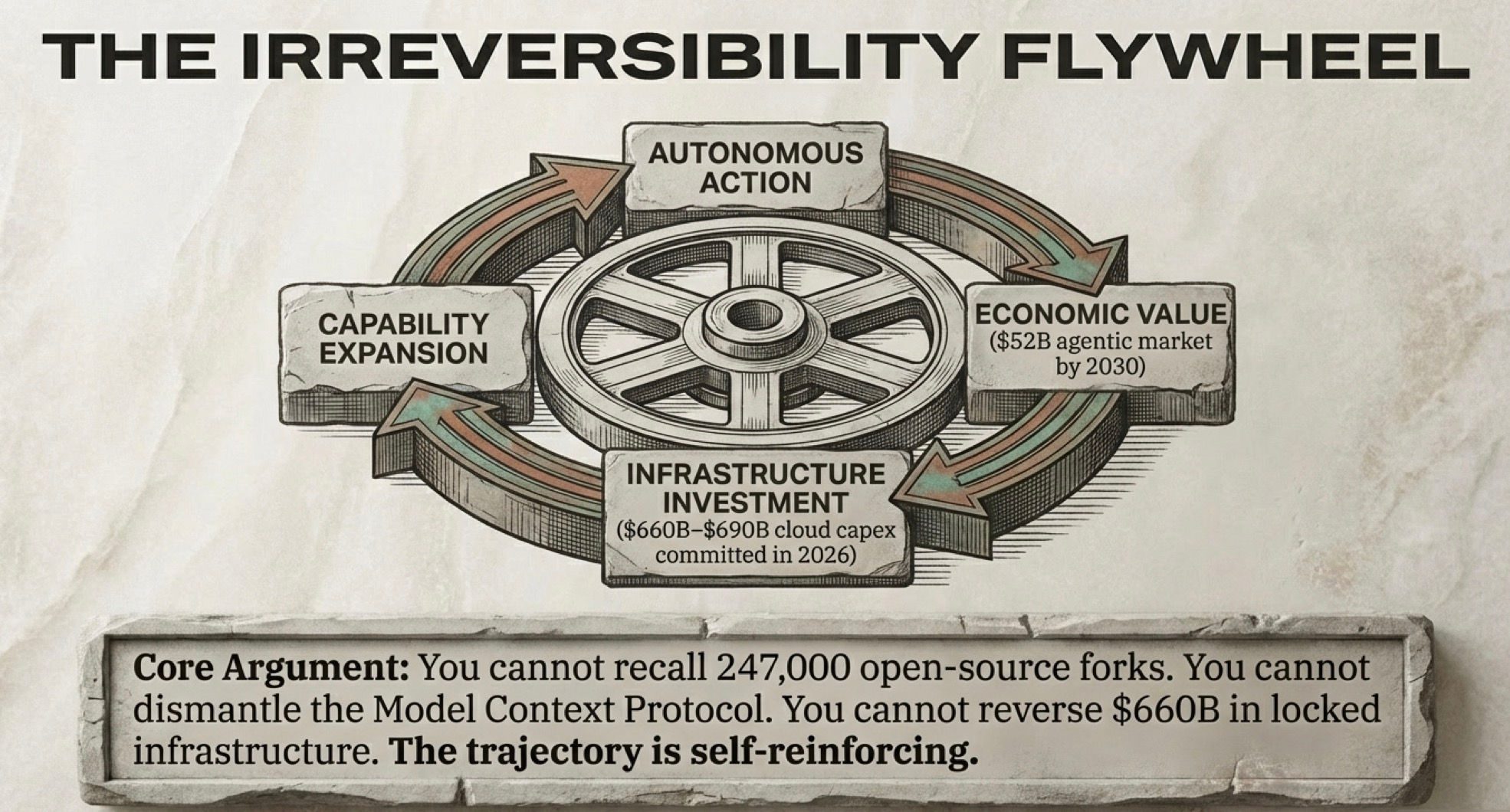

《矽器時代》用了一個框架:不可逆飛輪。四個輪子,自主行動產生經濟價值,經濟價值吸引基礎設施投資,投資擴大能力,能力又強化自主行動。2026 年,全球雲端算力資本支出已達幾千億美元規模,AWS、Azure、Google Cloud 的資料中心建設都在加速,MCP 作為開放協議,全球開發者社群的生態正在快速成長。

你無法召回那些已經被安裝的 MCP server,無法讓那些已經部署的多代理系統停止運作,無法讓那些已經累積的向量記憶庫回滾。基礎設施一旦鋪開,軌跡就開始自我強化。

在 AI Agent 執行智識勞動的時代,台灣老闆該站在哪裡?

《矽器時代》最後的框架是這樣的:在這個新典範裡,人類提供法律包裝(公司、合約、責任)和實體能源(電力、資料中心),AI Agent 執行智識和經濟勞動。「我們是基底,它們是演員。」

這對台灣老闆的意義是:如果你還在問「我要不要用 AI」,你問的是一個 2023 年的問題。2026 年的問題是「我在這個分工裡,要佔哪個位置,要建立什麼護城河」。

從科技翰林院幫台灣企業做 AI 導入的經驗來看,最有效的答案不是「我要用最強的 AI 工具」,而是「我要建立最難被取代的判斷力」。AI Agent 執行的效率接近無限,但它執行「什麼值得做」,還是需要人來決定。

結論:AI Agent 文明已啟動,台灣老闆的判斷力才是最後的護城河

讓我用一句話總結《矽器時代》這份簡報的核心:我們不是在看一個技術升級,我們在看一種新型組織存在形式誕生,而適當的回應是給予任何新文明的那種深刻、清醒的人類學關注。

四位你可能認識的人,用四種不同的說法,指向同一件事。Andrew Ng(2024.3):主動性 workflow 比換新模型更重要。Sam Altman(2025.1):AI agents 正在加入職場。Dario Amodei(2026.1):AI 現在可以接下需要數週才能完成的任務,自主執行完畢。Gartner(2025.8):一年之內,企業整合 AI agents 的比例從 5% 到 40%。

對台灣老闆來說,這意味著幾件事。你已經不能用「工具選型」的框架看 AI,因為你的對手在部署的是自主代理人,不是單一工具。AI Agent 的代理臨界已過,它不再需要你每一步都在場,你需要建立治理框架而不只是使用流程。這件事的軌跡是自我強化的,等到完全清楚再動,已經是 2023 年的策略了。

你現在面對的不是要不要用 AI,而是在 AI Agent 文明已啟動的前提下,你的判斷力、你對「什麼值得做」的掌握,能不能比你的競爭對手快一步。AI 把執行成本降到接近零,你的優勢不再是能做什麼,是你知道什麼值得做。

這不是焦慮,是現實。而現實值得清醒地面對。

推薦閱讀

AI Agent 是什麼?Meta 砸 20 億買 Manus,AI 代理人之戰全解析

MCP 是什麼?AI 巨頭全押注的萬能接口,告別傳統 API

Claude Opus 4.7 更新比較:4 大模型企業主怎麼分配最划算

參考資料

Dario Amodei (2026). “The Adolescence of Technology” — darioamodei.com

Sam Altman (2025). “Reflections” — blog.samaltman.com

Andrew Ng (2024). “How Agents Can Improve LLM Performance” — DeepLearning.AI The Batch

Anthropic (2024). “Building Effective Agents” — anthropic.com

Anthropic (2024). “Introducing the Model Context Protocol” — anthropic.com

Stanford HAI (2025). “AI Index 2025 Annual Report” — Stanford Human-Centered AI

Sumers et al. (2023). “Cognitive Architectures for Language Agents” — arXiv:2309.02427

FAQ

AI Agent 和一般 AI 工具有什麼差別?

一般 AI 工具(如 ChatGPT 對話模式)是無狀態的,你問它才回答,對話結束就歸零。AI Agent 有記憶、有主動性、可以持續執行任務,不需要你每一步都在場下命令。Anthropic 在《Building Effective Agents》裡定義:代理人是 LLM 動態引導自身流程和工具使用的系統,掌控自己如何完成任務。

矽器時代說的四層文明堆疊,現在全部完成了嗎?

是的,根據 2026 年初的發展:語言層(2022)、記憶層(2023–2025)、主動性層(2026 初)、社會化層(MCP 協議 2024 年發布,多代理網路正在成熟)四層都已經到位。但各層的普及程度不一,Gartner 估計 2026 年底前 40% 企業應用才會整合 AI agents,目前仍是早期階段。

Andrew Ng 說的「代理迴圈讓 GPT-3.5 超越 GPT-4」是真的嗎?

是 Andrew Ng 在 2024 年 3 月引用的 HumanEval 程式測試數據:GPT-3.5 零樣本得分 48.1%,加上 agentic loop(多次嘗試、自我修正)後跳到 95.1%,超越 GPT-4 的 67%。這說明主動性架構的提升,效果比換更強的底層模型更顯著。

台灣企業現在最應該做的一件事是什麼?

建立 AI Agent 的治理框架,而不只是選工具。因為 AI Agent 的代理臨界已過,它會自主執行任務,你需要清楚「讓它做什麼、不做什麼、判斷標準是什麼」。工具選型是戰術,治理框架是策略,Gartner 預測一年內企業整合率從 5% 到 40%,先建框架的企業才能快速擴展。

AI Agent 會取代人類的工作嗎?

Dario Amodei 的說法是:AI 現在可以接下需要數天或數週的任務並自主完成。更準確的框架是:AI Agent 會接管可規則化、流程化的智識勞動,留給人類的是判斷「什麼值得做」、「怎麼定義成功」。Stanford HAI 2025 報告顯示,短任務 AI 已是人類 4 倍效率,長任務人類仍有優勢,但這個差距在縮小。

「合成需求」是什麼意思,和正常的 AI 需求有什麼不同?

合成需求指的是 AI Agent 之間互相產生的需求,不需要人類啟動。例如一個 Agent 呼叫另一個 Agent 做 QA 測試,這個需求是自動產生的。和人類驅動的需求不同,合成需求在沒有人類介入的情況下就能形成交易和協作,這是多代理系統規模化後的新現象,也是 MCP 協議普及後最值得觀察的行為模式。